Материалы по тегу: hbm

|

11.04.2024 [22:27], Алексей Степин

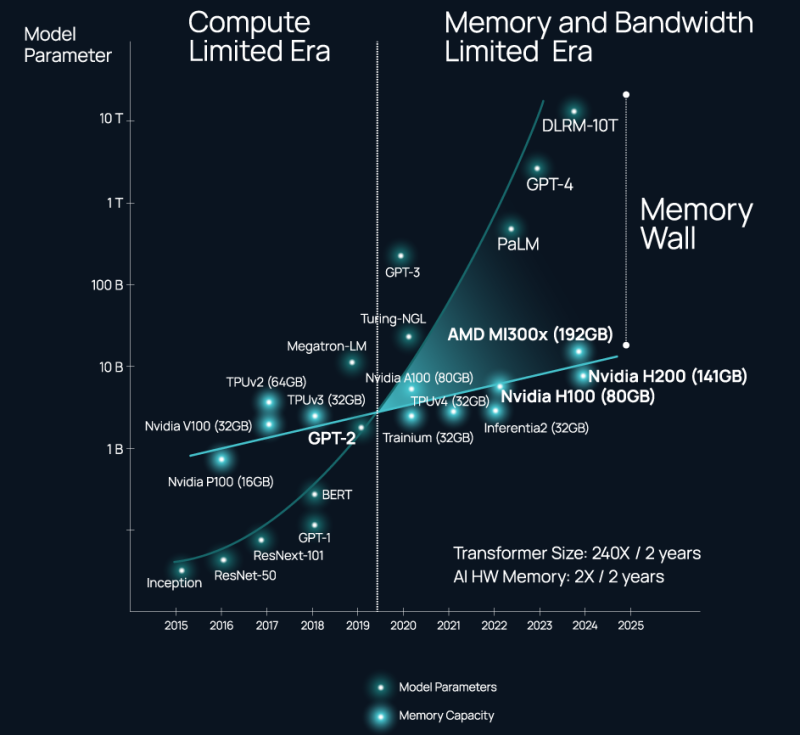

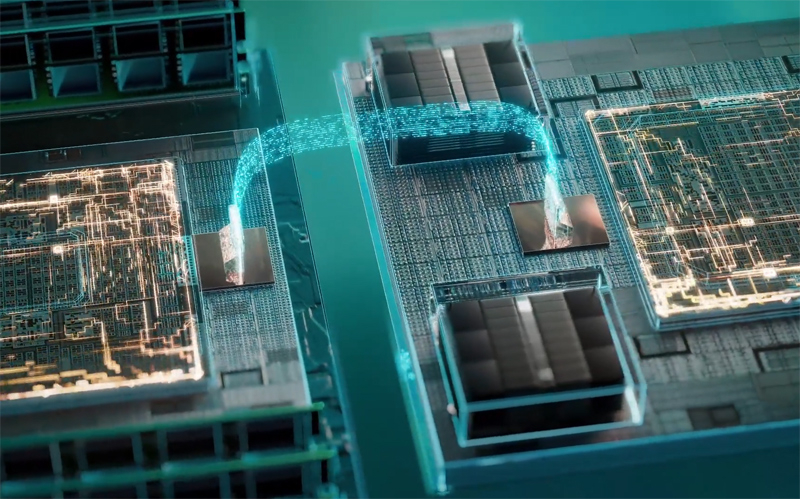

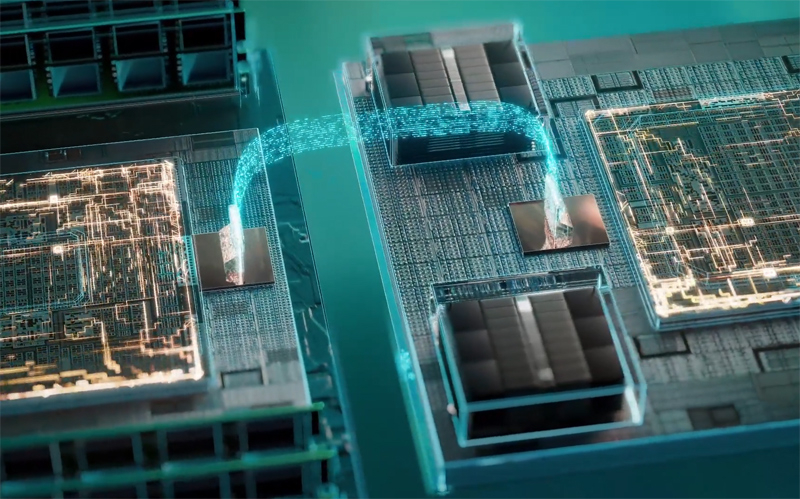

ИИ-ускорители NVIDIA являются самими дорогими в мире контроллерами памяти — Celestial AI предлагает связать оптикой HBM, DDR5 и процессорыВ 2024 году нельзя пожаловаться на отсутствие подходящего интерконнекта, если целью является «сшивка» в единую систему сотен, тысяч или даже десятков тысяч ускорителей. Есть NVIDIA NVLink и InfiniBand. Google использует оптические коммутаторы OCS, AMD вскоре выведет Infinity Fabric на межузловой уровень, да и старый добрый Ethernet отнюдь не собирается сдавать позиций и обретает новую жизнь в виде Ultra Ethernet. Проблема не в наличии и выборе подходящего интерконнекта, а в резкой потере пропускной способности за пределами упаковки чипа (т.н. Memory Wall). Да, память HBM быстра, но намертво привязана к вычислительным ресурсам, а в итоге, как отметил глава Celestial AI в комментарии изданию The Next Platform, индустрия ИИ использует ускорители NVIDIA в качестве самых дорогих в мире контроллеров памяти. Celestial AI ещё в прошлом году объявила, что ставит своей целью создание универсального «умного» интерконнекта на основе фотоники, который смог бы использоваться во всех нишах, требующих активного обмена большими потоками данных, от межкристалльной (chip-to-chip) до межузловой (node-to-node). Недавно она получила дополнительный пакет инвестиций объёмом $175 млн.

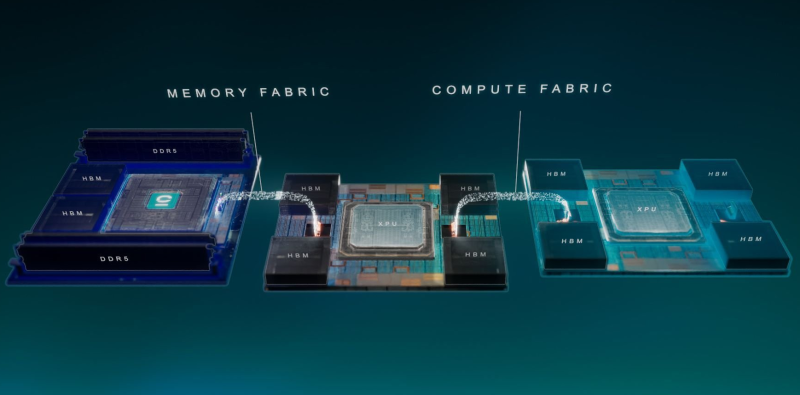

Источник изображений здесь и далее: Celestial AI Технология, названная Photonic Fabric, если верить заявлениям Celestial AI, способна в 25 раз увеличить пропускную способность и объёмы доступной памяти при на порядок меньшем энергопотреблении в сравнении с существующими системами соединений. Развивается она в трёх направлениях: чиплеты, интерпозеры и оптический аналог технологии Intel EMIB под названием OMIB. Наиболее простым способом интеграции своей технологии Celestial AI справедливо считает чиплеты. В настоящее время разработанный компанией модуль обеспечивает пропускную способность за пределами чипа на уровне 14,4 Тбит/с (1,8 Тбайт/с), а по размерам он немного уступает стандартной сборке HBM. Но это лишь первое поколение: во втором поколении Photonic Fabric 56-Гбит/с SerDes-блоки SerDes будут заменены на блоки класса 112 Гбит/с (PAM4). Поскольку речь идёт о системах с дезагрегацией ресурсов, проблему быстрого доступа к большому объёму памяти Celestial AI предлагает решить следующим образом: новый чиплет, содержащий помимо интерконнекта две сборки HBM общим объёмом 72 Гбайт, получит также поддержку четырёх DDR5 DIMM суммарным объёмом до 2 Тбайт. С использованием 5-нм техпроцесса такой чиплет сможет легко превратить HBM в быстрый сквозной кеш (write through) для DDR5. Фактически речь идёт об относительно простом и сравнительно доступном способе превратить любой процессор с чиплетной компоновкой в дезагрегированный аналог Intel Xeon Max или NVIDIA Grace Hopper. При этом латентность при удалённом обращении к памяти не превысит 120 нс, а энергозатраты в данном случае составят на порядок меньшую величину, нежели в случае с NVLink — всего 6,2 пДж/бит против 62,5 пДж/бит у NVIDIA. Таким образом, с использованием новых чиплетных контроллеров памяти становятся реальными системы, где все чипы, от CPU до сетевых процессоров и ускорителей, будут объединены единым фотонным интерконнектом и при этом будут иметь общий пул памяти DDR5 большого объёма с эффективным HBM-кешированием. По словам Celestial AI, она уже сотрудничает с некоторыми гиперскейлерами и с одним «крупным производителем процессоров». По словам руководителя Celestial AI, образцы чиплетов с поддержкой Photonic Fabric появятся во II половине 2025 года, а массовое внедрение начнется уже в 2027 году. Однако это может оказаться гонкой на выживание: Ayar Labs, другой разработчик фотоники, получившая поддержку со стороны Intel, уже показала прототип процессора с интегрированным фотонным интерконнектом. А Lightmatter ещё в декабре получила финансирование в объёме $155 млн на разработку фотонного интерпозера Passage и якобы уже сотрудничает с клиентами, заинтересованными в создании суперкомпьютера с 300 тыс. узлов. Нельзя сбрасывать со счетов и Eliyan, предлагающую вообще отказаться от технологии интерпозеров и заменить её на контроллеры физического уровня NuLink.

28.03.2024 [20:42], Сергей Карасёв

Оптика для HBM: стартап Celestial AI получил ещё $175 млн инвестиций, в том числе от AMD и SamsungКомпания Celestial AI, занимающаяся созданием технологий оптического интерконнекта, сообщила о проведении раунда финансирования Series C, в ходе которого привлечено $175 млн. Деньги будут использованы для ускорения разработки и вывода передовых продуктов на коммерческий рынок. Летом прошлого года Celestial AI объявила о разработке технологии Photonic Fabric. Она ориентирована на ИИ-платформы и системы НРС. Благодаря оптическому интерконнекту нового типа ИИ-чипы могут быть соединены с большим пулом высокопроизводительной памяти HBM3, а в перспективе — и HBM4. Таким образом, решается проблема ограниченного объёма памяти HBM в составе ИИ-ускорителей. По заявлениям Celestial AI, технология Photonic Fabric обеспечивает повышение пропускной способности и объёма доступной памяти более чем в 25 раз при одновременном снижении задержек и энергопотребления примерно в 10 раз по сравнению с существующими оптическими альтернативами и традиционными медными соединениями. Таким образом, можно масштабировать нагрузки ИИ.

Источник изображения: Celestial AI В июне 2023 года Celestial AI провела раунд финансирования Series B на сумму в $100 млн. Тогда средства предоставили IAG Capital Partners, Koch Disruptive Technologies (KDT), Temasek Xora Innovation, Samsung Catalyst, Smart Global Holdings (SGH), Porsche Automobil Holding SE, The Engine Fund, imec.xpand, M Ventures и Tyche Partners. Инвестиционная программа Series C проведена под предводительством Фонда инновационных технологий США (USIT) миллиардера Томаса Талла (Thomas Tull), основателя Legendary Entertainment. В программе также приняли участие AMD Ventures, KDT, Temasek, Xora Innovation, IAG Capital Partners, Samsung Catalyst, SGH, Porsche Automobil Holding SE, Engine Ventures, M-Ventures и Tyche Partners.

23.03.2024 [22:29], Владимир Мироненко

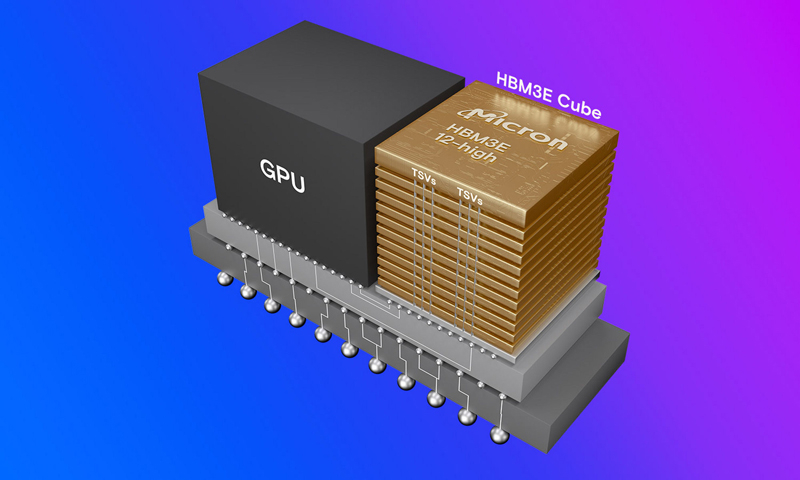

Micron уже продала всю HBM3E-память, которую выпустит в 2024 году и распределила заказы на 2025 годКомпания Micron Technology, приступившая в феврале к массовому производству передовой памяти HBM3E, сообщила, что уже имеет на руках контракты на весь объём поставок до конца 2024 года, а также на большую часть поставок в 2025 году. Память Micron HBM3E (Micron называет её HBM3 Gen2) одной из первых получила сертификацию для использования в ускорителях NVIDIA (G)H200, так что, по всей видимости, Micron станет ключевым поставщиком для NVIDIA, пишет AnandTech. «Наша HBM распродана на 2024 календарный год и подавляющая часть наших поставок на 2025 год уже распределена, — сообщил глава Micron Санджей Мехротра (Sanjay Mehrotra) в комментариях к отчёту за II квартал 2024 финансового года. Первый продукт HBM3E от Micron представляет собой сборку 8-Hi ёмкостью 24 Гбайт с 1024-бит интерфейсом и общей пропускной способностью 1,2 Тбайт/с. NVIDIA H200 использует шесть таких модулей. Micron также начала поставки образцов сборок 12-Hi ёмкостью 36 Гбайт.

Источник изображения: Micron В отчёте за II квартал 2024 финансового года Micron похвасталась результатами, которые оказались значительно выше прогнозов. Напомним, что до этого у компании были убытки пять кварталов подряд. В отчётном квартале Micron получила выручку в размере $5,82 млрд, превысив на 58 % на результат II квартала 2023 финансового года, равный $3,69 млрд, и на 23 % — результат предыдущего квартала, равный $4,73 млрд. При этом доля в общей выручке продаж DRAM составила 71 %, NAND — 27 %. Поставки подразделения сетевых и вычислительных решений (Compute and Networking, CNBU) выросли год к году на 59 % до $2,2 млрд, мобильного подразделения (Mobile, MBU) — на 69 % до $1,6 млрд, у подразделения встраиваемых решений (Embedded, EBU) зафиксирован рост на 28 % до $1,11 млрд, у подразделения решений для СХД — рост на 79 % до $905 млн. Компания сообщила о прибыли в размере $793 млн или $0,71 на акцию, в то время как годом ранее у неё были убытки (GAAP) в $2,31 млрд или $2,12 на акцию. Скорректированная прибыль (non-GAAP) составила $0,42 на акцию по сравнению с убытком в $1,91 на акцию годом ранее. Согласно прогнозу аналитиков, опрошенных FactSet, у Micron должны были быть убытки (non-GAAP) в размере $0,25 на акцию при выручке в $5,35 млрд. В текущем квартале Micron ожидает получить скорректированную прибыль (non-GAAP) в размере $0,42 на акцию при выручке в $6,6 млрд. Аналитики Уолл-стрит прогнозируют в III финансовом квартале прибыль (non-GAAP) в размере $0,09 на акцию при выручке в $6 млрд.

28.02.2024 [15:31], Сергей Карасёв

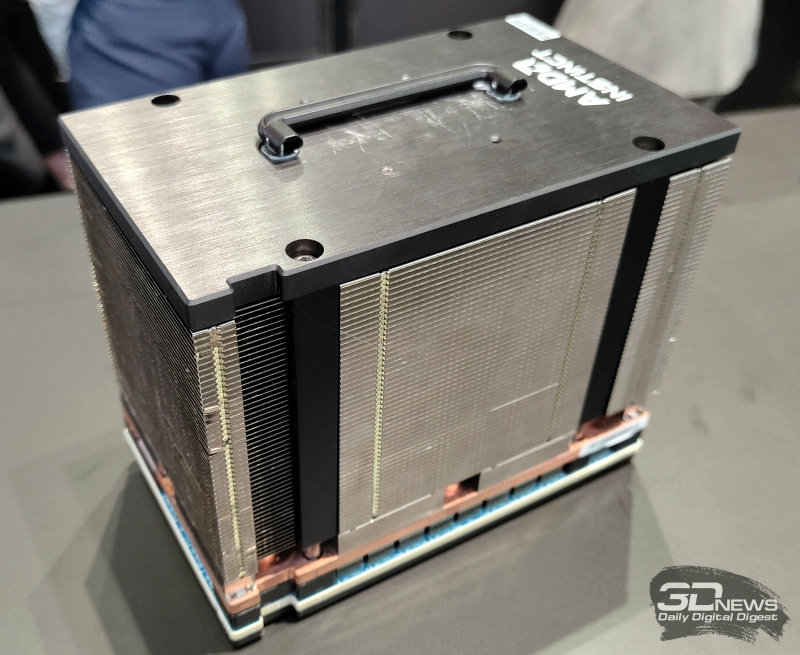

На MWC 2024 замечен первый образец ускорителя AMD Instinct MI300X с 12-слойной памятью HBM3EКомпания AMD готовит новые модификации ускорителей семейства Instinct MI300, которые ориентированы на обработку ресурсоёмких ИИ-приложений. Изделия будут оснащены высокопроизводительной памятью HBM3E. Работу над ними подтвердил технический директор AMD Марк Пейпермастер (Mark Papermaster), а уже на этой неделе на стенде компании на выставке MWC 2024 был замечен образец обновлённого ускорителя. На сегодняшний день в семейство Instinct MI300 входят модификации MI300A и MI300X. Первая располагает 228 вычислительными блоками CDNA3 и 24 ядрами Zen4 на архитектуре x86. В оснащение входят 128 Гбайт памяти HBM3. На более интенсивные вычисления ориентирован ускоритель MI300X, оборудованный 304 блоками CDNA3 и 192 Гбайт HBM3. Но у этого решения нет ядер Zen4. Недавно компания Micron сообщила о начале массового производства 8-слойной памяти HBM3E ёмкостью 24 Гбайт с пропускной способностью более 1200 Гбайт/с. Эти чипы будут применяться в ИИ-ускорителях NVIDIA H200, которые выйдут на коммерческий рынок во II квартале нынешнего года. А Samsung готовится к поставкам 12-слойных чипов HBM3E на 36 Гбайт со скоростью передачи данных до 1280 Гбайт/с. AMD подтвердила намерение применять память HBM3E в обновлённых ускорителях Instinct MI300, но в подробности вдаваться не стала. В случае использования 12-слойных чипов HBM3E ёмкостью 36 Гбайт связка из восьми модулей обеспечит до 288 Гбайт памяти с высокой пропускной способностью. Наклейка на демо-образце недвусмысленно указывает на использование именно 12-слойной памяти. Впрочем, это может быть действительно всего лишь стикер, поскольку представитель AMD уклонился от прямого ответа на вопрос о спецификациях представленного изделия. Ожидается также, что в 2025 году AMD выпустит ИИ-ускорители следующего поколения серии Instinct MI400. Между тем NVIDIA готовит ускорители семейства Blackwell для ИИ-задач: эти изделия, по заявлениям самой компании, сразу после выхода на рынок окажутся в дефиците.

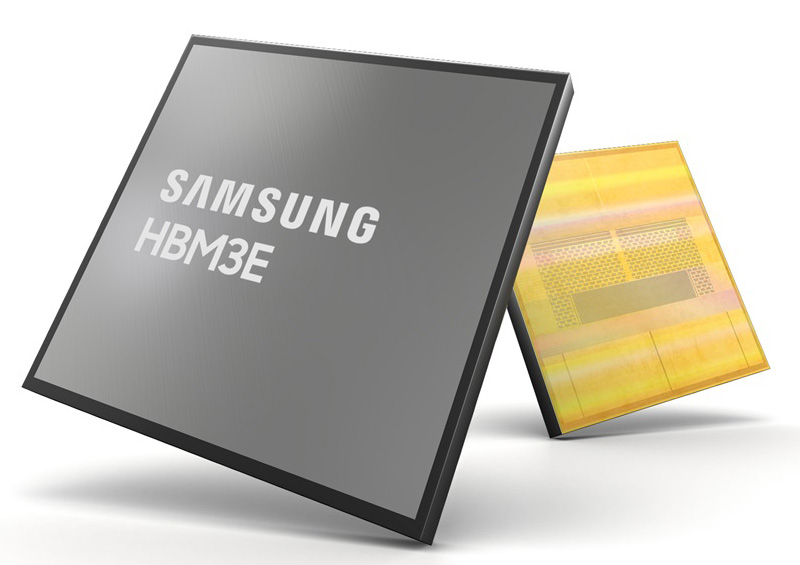

28.02.2024 [14:04], Сергей Карасёв

В Samsung разработаны первые в отрасли 12-слойные чипы HBM3E ёмкостью 36 ГбайтКомпания Samsung Electronics объявила о разработке первых в отрасли чипов высокопроизводительной памяти HBM3E в виде 12-ярусных стеков общей ёмкостью 36 Гбайт. Изделия ориентированы на применение в системах ИИ с большой вычислительной нагрузкой. Новые чипы Samsung HBM3E обеспечивают пропускную способность до 1280 Гбайт/с. По этому показателю, как утверждается, решения более чем на 50 % превосходят доступные на рынке 8-слойные стеки HBM3. При изготовлении чипов Samsung применяет технологию термокомпрессии в комплексе с диэлектрической плёнкой. В результате, суммарная высота полученных 12-слойных изделий эквивалентна высоте 8-слойных. Samsung добилась наименьших в отрасли зазоров в стеке — всего 7 мкм, а также устранила пустоты между слоями. Это позволило поднять плотность вертикальной компоновки более чем на 20 % по сравнению с 8-слойными продуктами HBM3. Кроме того, при производстве стеков Samsung использует между слоями памяти контактные выступы разного размера. Небольшие выступы служат для передачи сигналов, тогда как более крупные улучшают отвод тепла. Такой подход, по заявлениям Samsung, также способствует снижению доли брака. В целом, как утверждается, внедрение 12-слойной памяти HBM3E по сравнению с 8-слойными изделиями даёт возможность увеличить скорость обучения ИИ-моделей на 34 %, тогда как количество одновременно обслуживаемых пользователей систем инференса может вырасти в 11,5 раз. Пробные поставки новых чипов уже начались, а массовое производство намечено на I половину 2024 года. Нужно отметить, что буквально на днях компания Micron объявила о начале массового производства 8-слойной памяти HBM3E на 24 Гбайт с пропускной способностью более 1,2 Тбайт/с. Кроме того, Micron уже в марте начнёт распространять образцы 12-ярусных чипов HBM3E ёмкостью 36 Гбайт.

27.02.2024 [13:25], Сергей Карасёв

Micron начала массовое производство памяти HBM3E для ускорителей NVIDIA H200Компания Micron Technology объявила о начале массового производства передовой памяти HBM3E. Речь идёт об изделиях ёмкостью 24 Гбайт, предназначенных для ИИ-ускорителей NVIDIA H200, которые появятся на коммерческом рынке во II квартале нынешнего года. Чипы Micron HBM3E выполнены в виде 8-ярусного стека. Заявленная скорость передачи данных превышает 9,2 Гбит/с на контакт, а общая пропускную способность сборки превосходит 1,2 Тбайт/с. Вместе с тем, как утверждается, изделия потребляют примерно на 30 % меньше энергии по сравнению с решениями конкурентов. Micron подчёркивает, что чипы HBM3E объёмом 24 Гбайт позволяют дата-центрам беспрепятственно масштабировать различные ИИ-нагрузки — от обучения сложных нейронных сетей до ускорения инференса. Изделия выполнены по технологии 1β (1-бета) — самому передовому техпроцессу компании. Кроме того, применены другие современные методики упаковки чипов, включая усовершенствованную технологию сквозных соединений TSV (Through-Silicon Via). Micron также сообщила, что уже в марте нынешнего года начнёт распространять образцы 12-ярусных чипов HBM3E ёмкостью 36 Гбайт. Они, как и изделия на 24 Гбайт, обеспечат пропускную способность свыше 1,2 Тбайт/с при высокой энергетической эффективности.

21.10.2023 [15:26], Сергей Карасёв

Samsung представила чипы памяти HBM3E с пропускной способностью более 1,2 Тбайт/сКомпания Samsung Electronics в ходе ежегодного мероприятия Memory Tech Day сообщила о начале поставок образцов микросхем памяти HBM3E нового поколения с кодовым названием Shinebolt. Утверждается, что изделия Shinebolt обеспечивают прирост производительности примерно на 50 % по сравнению с чипами HBM3E предыдущего поколения (Icebolt). Пропускная способность в расчёте на контакт достигает 9,8 Гбит/с против 6,4 Гбит/с у Icebolt.

Источник изображения: Samsung Таким образом, общая пропускная способность микросхем Shinebolt составляет до 1,228 Тбайт/с. Это позволяет использовать память в высоконагруженных системах, обрабатывающих приложения генеративного ИИ и машинного обучения. С целью повышения плотности компоновки и улучшения тепловых характеристик Samsung оптимизировала свою технологию непроводящей пленки (NCF): это позволило минимизировать зазоры между слоями чипа и максимизировать теплопроводность. Samsung планирует производить 12-ярусные чипы Shinebolt с максимальной ёмкостью 36 Гбайт. Среди других продуктов, представленных компанией Samsung на мероприятии Memory Tech Day, — 32-гигабитные чипы DDR5 DRAM, первая в отрасли память GDDR7 с пропускной способностью 32 Гбит/с и архитектура PBSSD для создания решений «петабайтного класса».

21.08.2023 [10:17], Сергей Карасёв

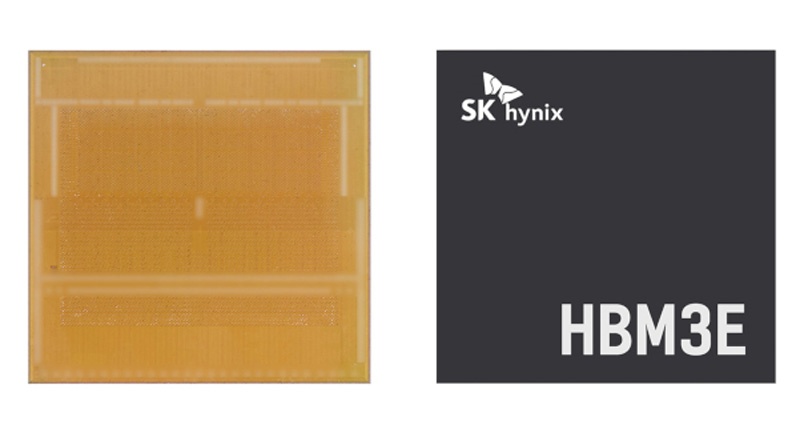

SK hynix заявила о создании самой быстрой в мире памяти HBM3EКомпания SK hynix объявила о разработке самой высокопроизводительной в мире памяти HBM3E, предназначенной для использования в современных ИИ-системах. Образцы изделий уже поставляются отдельным заказчикам для оценки технических характеристик. HBM3E — это пятое поколение памяти данного типа, приходящее на смену изделиям HBM, HBM2, HBM2E и HBM3. HBM3E представляет собой улучшенную версию HBM3. Массовое производство HBM3E компания SK hynix намерена организовать в первой половине следующего года.

Источник изображения: SK hynix По заявлениям разработчика, память HBM3E соответствует самым высоким отраслевым стандартам скорости передачи данных. Таким образом, изделия подходят для применения в наиболее нагруженных ИИ-платформах. Кроме того, при создании памяти были учтены жёсткие требования в плане рассеяния тепла. Утверждается, что изделия HBM3E способны перемещать информацию со скоростью до 1,15 Тбайт/с. При изготовлении чипов компания SK hynix применяет технологию Advanced Mass Reflow Molded Underfill (MR-MUF), представляющую собой метод объединения нескольких чипов памяти на одной подложке посредством спайки. Это даёт возможность улучшить теплоотведение приблизительно на 10%. Говорится об обратной совместимости с HBM3, что упрощает внедрение новой памяти. По оценкам, доля SK hynix на мировом рынке памяти HBM по итогам 2022 года составила приблизительно 50 %. В текущем году, как ожидается, этот показатель окажется на уровне 46–49 %, в 2024 году — 47–49 %.

20.08.2023 [11:10], Сергей Карасёв

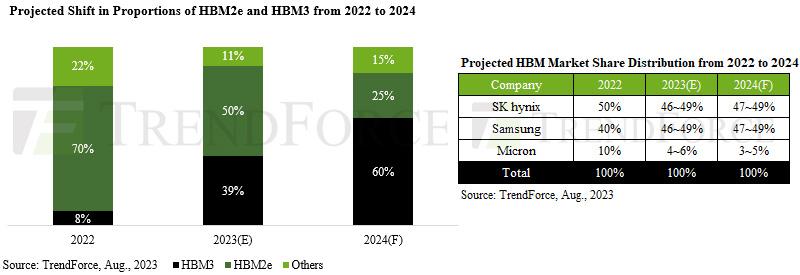

Поставки HBM-памяти в 2024 году вырастут вдвоеКомпания TrendForce опубликовала свежий прогноз по глобальному рынку чипов памяти HBM: аналитики полагают, что спрос на эту продукцию будет быстро расти на фоне стремительно развивающихся ИИ-технологий. Объём поставок HBM в 2024 году может увеличиться на 105 % по сравнению с 2023-м, при этом ожидается смещение фокуса с изделий HBM2e в сторону HBM3. В 2022 году, как отмечает TrendForce, около 70 % поставок пришлось на чипы HBM2e, тогда как доля HBM3 составила только 8 %. В 2023-м, как ожидается, эти показатели окажутся на уровне 50 % и 39 % соответственно. А в 2024 году решения HBM3 уйдут в отрыв, показав результат примерно 60 % против 25 % у HBM2e.

Источник изображения: TrendForce Анализ TrendForce показывает, что 2023–2024 гг. станут ключевыми для развития ИИ, что вызовет значительный рост спроса на чипы HBM. Однако надвигающийся бум производства HBM поставил поставщиков в затруднительное положение: им необходимо найти баланс между удовлетворением потребностей клиентов и недопущением формирования складских излишков из-за перепроизводства. Ещё одной проблемой является потенциальный риск «раздутого» бронирования, поскольку заказчики, ожидающие нехватку HBM, могут переоценить свои потребности. В настоящее время SK hynix удерживает лидерство в производстве HBM, выступая в качестве основного поставщика таких чипов для ускорителей NVIDIA. Доля SK hynix по итогам 2022 года составила приблизительно 50 %. Ещё 40 % досталось Samsung, оставшиеся 10 % — Micron. В 2023 году, полагает TrendForce, доли SK hynix и Samsung будут колебаться в пределах 46–49 %, а доля Micron составит 4–6 %. В следующем году, согласно прогнозам, позиции SK hynix и Samsung окажутся в диапазоне 47–49 %. Micron будет удерживать 3–5 % отрасли. Несмотря на то, что поставщики ещё не завершили разработку своих ценовых политик на 2024 год, TrendForce не исключает возможности дальнейшего снижения цен на продукты HBM2 и HBM2e. А вот цены на HBM3, по прогнозам, останутся такими же, как и в 2023 году.

14.07.2023 [19:40], Алексей Степин

Samsung и SK Hynix работают над снижением энергопотребления оперативной памятиЧем активнее внедряются ИИ-системы, тем важнее становится роль памяти HBM и DDR5, а в особенности её энергоэффективность. Так, в крупномасштабных системах на базе NVIDIA A100 на долю памяти может приходиться до 40 % потребляемой энергии. Неудивительно, что крупные производители памяти объединяют свои усилия с академическими кругами, чтобы разработать более экономичную память нового поколения. В частности, Samsung на базе CXL и 12-нм техпроцесса уже разработала чипы DDR5 ёмкостью 16 Гбайт, который на 23 % экономичнее в сравнении с аналогичными чипами предыдущего поколения. В содействии с Сеульским национальным университетом (Seoul National University) Samsung продолжает вести работы по дальнейшему снижению энергопотребления. Сам университет также ведёт исследования в этом направлении и уже разработал новую технологию DRAM Translation Layer. Ожидается, что её внедрение поможет снизить энергопотребление DRAM ещё на 31,6 %.

Источник: SK Hynix Не отстаёт от Samsung и другой крупный производитель устройств памяти, компания SK Hynix. Она представила новое поколение LPDDR5X, в котором применен техпроцесс High-K Metal Gate (HKMG). Благодаря материалу с оптимизированной диэлектрической проницаемостью удалось впятеро повысить заряд в ячейке, снизив при этом токи утечки. В итоге новая память LPDDR5X от SK Hynix может похвастаться на 33 % более высокой производительностью при 20 % экономии в энергопотреблении, в сравнении с предыдущим поколением. |

|