Материалы по тегу: epyc

|

19.09.2023 [16:59], Сергей Карасёв

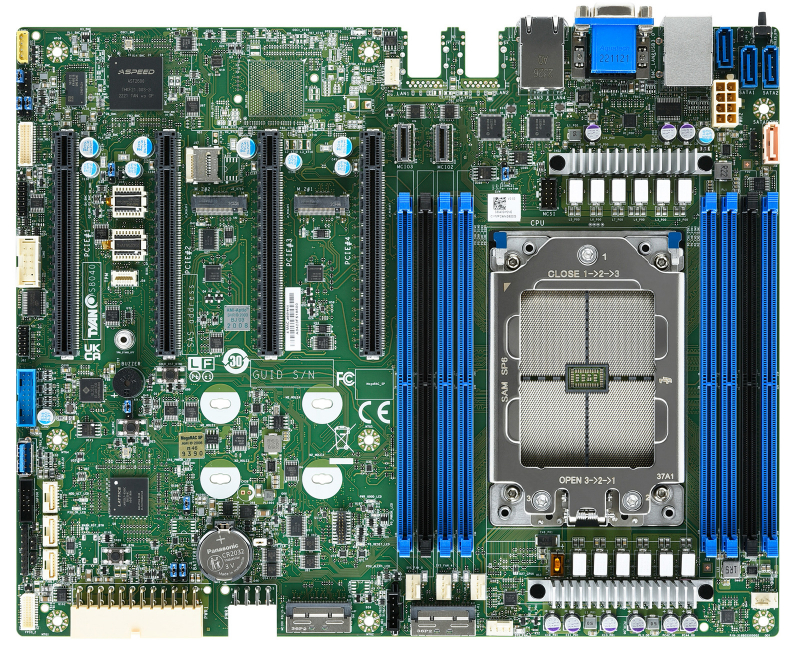

ASUS выпустила материнскую плату S14NA-U12 для серверов на AMD EPYC SienaКомпания ASUS анонсировала материнскую плату S14NA-U12 типоразмера CEB, предназначенную для построения серверов на процессорах AMD EPYC 8004 Siena. Допускается установка одного чипа в исполнении Socket SP6 (LGA 4844) с показателем TDP до 225 Вт. Новинка располагает 12 слотами для модулей оперативной памяти DDR5-4800/4000/3600 RDIMM/3DS RDIMM суммарным объёмом до 3 Тбайт. Есть два разъёма PCIe 5.0 x16 и один слот PCIe 5.0 x8. Доступны два коннектора M.2 с поддержкой модулей формата 2280/22110 с интерфейсом PCIe 5.0 x4 или SATA-3. Кроме того, предусмотрены пять разъёмов MCIO с поддержкой PCIe 5.0 x8. В оснащение входит двухпортовый сетевой контроллер Broadcom BCM57414B1KFSBG стандарта 25GbE. Интерфейсный блок содержит два порта USB 3.2 Gen1, два коннектора SFP28, аналоговый разъём D-Sub, а также сетевой порт управления с гнездом RJ-45. Через разъёмы на самой плате можно задействовать дополнительные порты USB 3.2 Gen1 и последовательный порт. Диапазон рабочих температур простирается от +10 до +35 °C. Габариты материнской платы составляют 305 × 267мм.

19.09.2023 [15:07], Сергей Карасёв

Исследовательская лаборатория ВВС США получила суперкомпьютер Raider мощностью 12 ПфлопсВысокопроизводительный вычислительный комплекс для Исследовательской лаборатории ВВС США (AFRL), по сообщению ресурса Datacenter Dynamics, прибыл на базу Райт-Паттерсон в Огайо. Суперкомпьютер, построенный Penguin Computing, получил название Raider.

Изображения: AFRL Новая НРС-система имеет производительность приблизительно 12 Пфлопс. Raider является частью более широкой программы модернизации высокопроизводительных вычислений Министерства обороны и будет доступен ВВС, армии и флоту США. Суперкомпьютер примерно в четыре раза мощнее своего предшественника — комплекса Thunder, запущенного в 2015 году: у этой системы производительность составляет 3,1 Пфлопс. Использовать Raider планируется прежде всего для решения сложных задач в области моделирования различных процессов. В опубликованных в прошлом году документах говорится, что Raider должен был получить 189 тыс. вычислительных ядер. Предполагалось, что система будет включать 356 узлов различного назначения и конфигурации и получит процессоры AMD EPYC 7713 (Milan), 44 Тбайт RAM, 152 ускорителя NVIDIA A100, 200G-интерконнект InfiniBand HDR и 20-Пбайт хранилище. Однако заявленная производительность этой системы составляла 6,11 Пфлопс, так что характеристики суперкомпьютера явно скорректировали. В дополнение к Raider Исследовательская лаборатория ВВС США заказала два других суперкомпьютера — TI-23 Flyer и TI-Raven, которые, как ожидается, будут обеспечивать производительность на уровне 14 Пфлопс. Ввод этих систем в эксплуатацию запланирован на 2024 год.

19.09.2023 [10:54], Сергей Карасёв

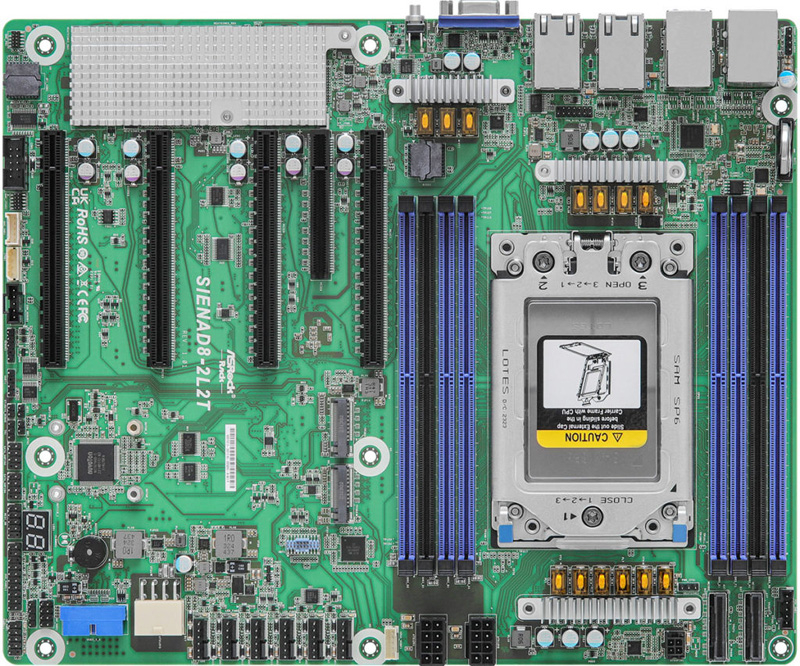

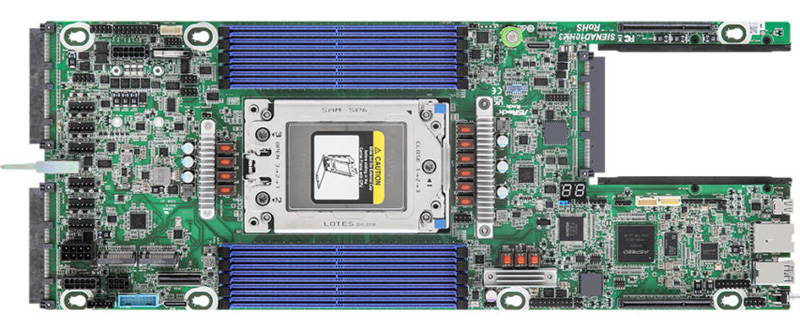

ASRock Rack представила серверные платы для процессоров AMD EPYC SienaКомпания ASRock Rack анонсировала материнские платы с поддержкой новейших процессоров AMD EPYC 8004 Siena в исполнении Socket SP6 (LGA 4844). Дебютировали модели SIENAD8-2L2T, SIENAD8UD-2L2Q и SIENAD10HM3, предназначенные для построения односокетных серверов. Версия SIENAD8-2L2T выполнена в формате АТХ. Она снабжена восемью слотами для модулей оперативной памяти DDR5-4800, четырьмя разъёмами PCIe 5.0 x16 (в том числе с поддержкой CXL1.1) и разъёмом PCIe 5.0 x8. Есть два коннектора M.2 22110/2280 (PCIe 5.0 x4), по два сетевых порта 10GbE и 1GbE с коннекторами RJ45, а также сетевой порт управления. Плюс к этому доступны два порта USB 3.2 Gen1 Type-A и аналоговый разъём D-Sub.

Источник изображений: ASRock Rack Плата SIENAD8UD-2L2Q, в свою очередь, соответствует типоразмеру Deep Micro-ATX. Предусмотрены восемь слотов DDR5-4800, два разъёма PCIe5.0 / CXL1.1 x16, слот PCIe5.0 / CXL1.1 x8, два коннектора M.2 22110/2280 (PCIe 5.0 x4), два коннектора MCIO (PCIe 5.0 x8 или 8 × SATA-3), три разъёма MCIO (PCIe 5.0 x8) и коннектор OCuLink (PCIe 3.0 x4). Есть по два порта 1GbE RJ45 и 25GbE SFP28, выделенный сетевой порт управления, два порта USB 3.2 Gen1 Type-A и разъём D-Sub.  Модель SIENAD10HM3 половинной ширины получила 10 разъёмов DDR5-4800, два слота Slim Cool Edge PCIe 5.0 x16, два коннектора M.2 22110/2280 (PCIe 5.0 x4 или SATA-3), по одному разъёму MCIO (PCIe 5.0 / CXL1.1 x8 или 8 × SATA-3) и OCuLink (PCIe 3.0 x4). Имеются контроллеры ASPEED AST2600 и Realtek RTL8211F (выделенный сетевой порт управления).

19.09.2023 [10:38], Сергей Карасёв

TYAN анонсировала серверы на AMD EPYC Siena и платы для новых чиповКомпания TYAN, подразделение MiTAC Computing Technology Corporation, представила новые продукты с поддержкой процессоров AMD EPYC 8004 Siena. В частности, дебютировали односокетная материнская плата Tomcat CX S8040 и сервер Transport CX GC73A B8046 типоразмера 1U. Плата Tomcat CX S8040 выполнена в формате ATX с размерами 305 × 243,8 мм. Допускается установка процессоров в исполнении Socket SP6 с показателем TDP до 225 Вт. Есть восемь слотов для модулей оперативной памяти DDR5-4800/3600 и четыре порта SATA-3. Новинка располагает четырьмя слотами PCIe 5.0 x16 и двумя разъёмами M.2 22110/2280 (NVMe). Кроме того, предусмотрены по два коннектора MCIO 8x и MCIO 4x, по два сетевых порта 10GbE и 1GbE, порт управления 1GbE, коннектор D-Sub и последовательный порт. Диапазон рабочих температур простирается от +10 до +35 °C. В свою очередь, сервер Transport CX GC73A B8046 имеет габариты 730 × 438,5 × 43,6 мм. Он несёт на борту материнскую плату S8046GM с возможностью установки одного чипа в исполнении Socket SP6 (до 225 Вт). Доступны 12 слотов для модулей RDIMM DDR5-4800. Во фронтальной части расположены 12 отсеков для SFF-накопителей. Есть слоты расширения FH/HL и FH/FL с поддержкой PCIe 5.0 x16, сетевой адаптер Realtek RTL8211F стандарта 1GbE, контроллер Aspeed AST2600, два порта USB 3.2 Gen.1 и порт USB 2.0. Питание обеспечивают два блока мощностью 1300 Вт с сертификатом 80 Plus Titanium.

18.09.2023 [21:55], Алексей Степин

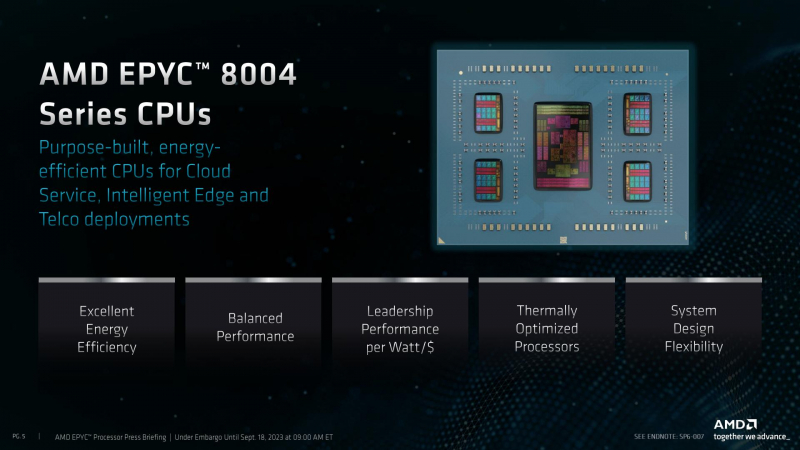

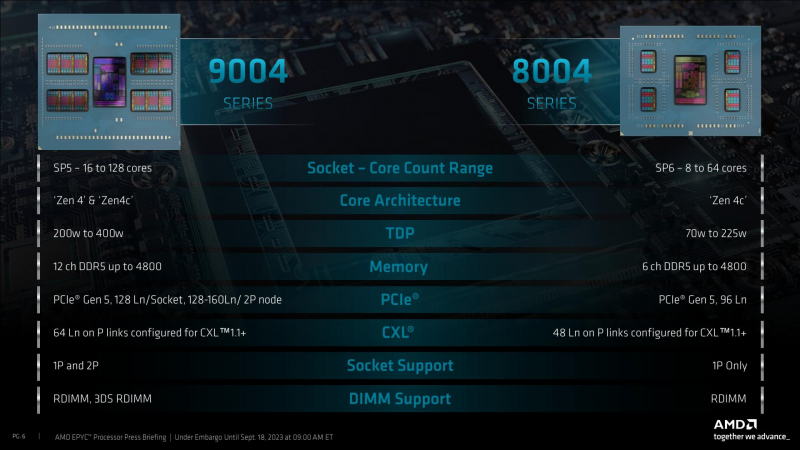

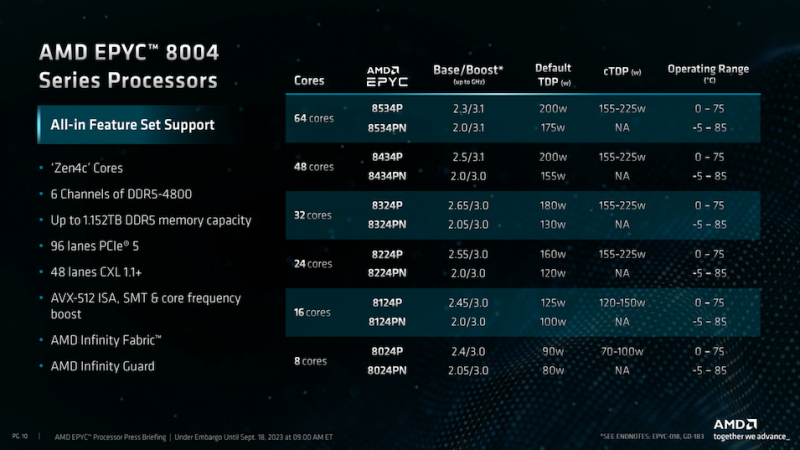

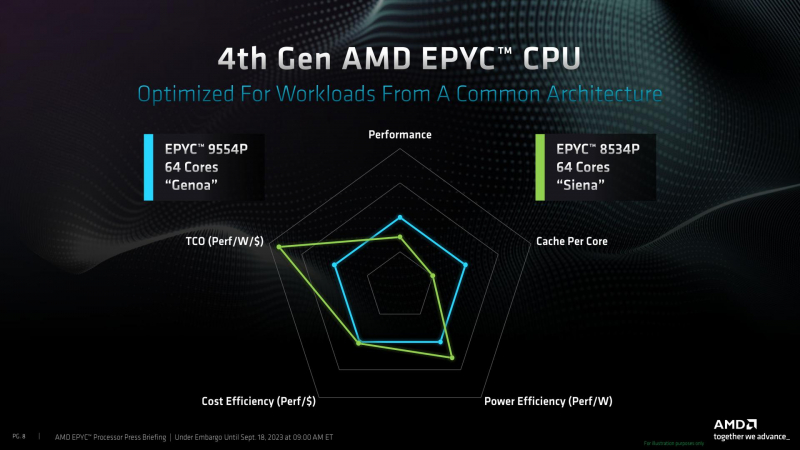

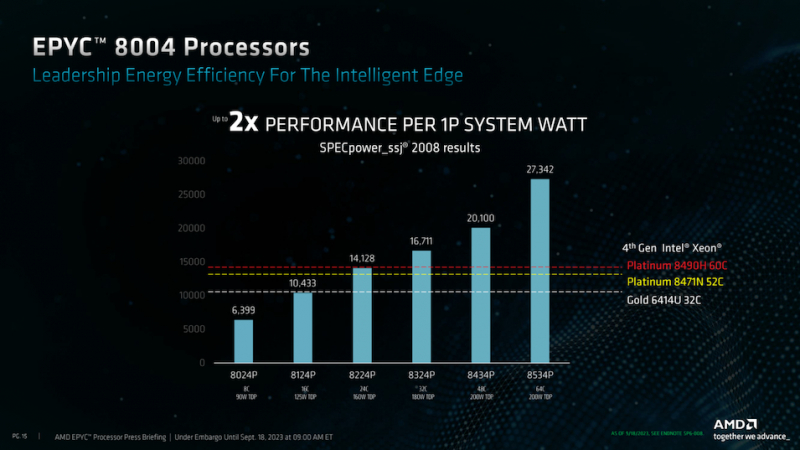

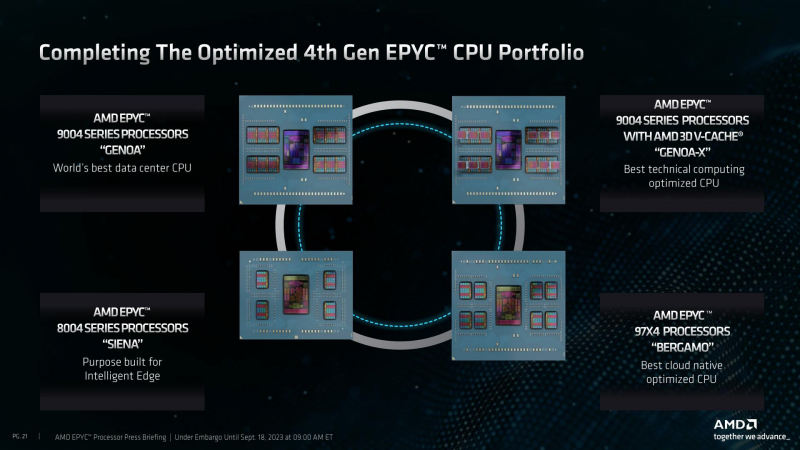

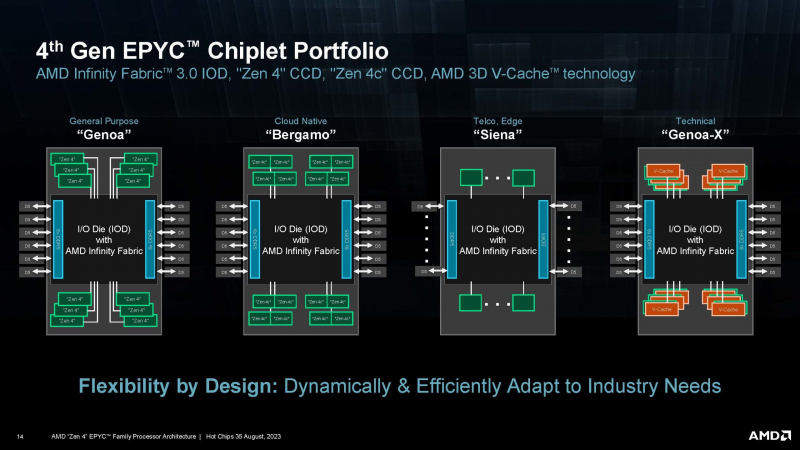

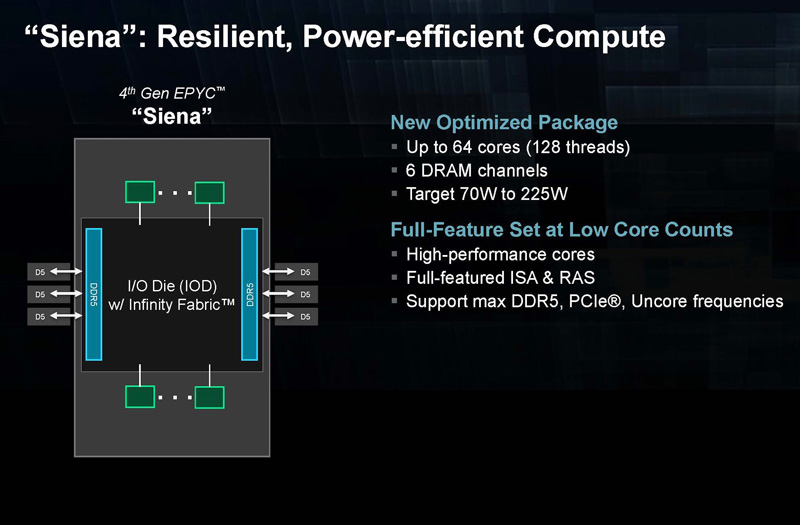

AMD представила процессоры EPYC 8004 Siena — Zen 4c для периферийных вычисленийКомпания AMD продолжает экспансию на серверном рынке: сегодня она анонсировала выпуск новой разновидности процессоров EPYC четвёртого поколения — чипы EPYC 8004, известные под кодовым именем Siena. Это энергоэффективные процессоры, предназначенные для применения в сфере периферийных вычислений и телекоммуникационного оборудования. Архитектурно ничего нового в EPYC 8004 нет — основе лежит тот же дизайн ядер Zen 4c, применяемый в процессорах EPYC Bergamo и позволивший создать AMD первые в мире 128-ядерные процессоры с архитектурой x86. В числе прочего, это означает и наличие поддержки AVX-512. Компания продолжает придерживаться уже хорошо освоенной модели создания новых процессоров путём компоновки вычислительных 5-нм чиплетов CCD вокруг унифицированного 6-нм чиплета IOD, выполняющего роль хаба ввода-вывода. Однако есть и существенные изменения. Так, в процессорах серии Siena была серьёзно усечена подсистема памяти, с 12 до 6 каналов DDR5. Также пострадала подсистема PCI Express, включающая 96 линий PCIe 5.0 вместо 128. Всё это позволило сделать процессоры компактнее, но потребовало введения нового сокета SP6 с меньшим числом контактов — 4844 против 6096 контактов у SP5. Такой ход позволит снизить себестоимость производства системных плат для EPYC 8004, тем более что поддержки двухпроцессорных конфигураций новые чипы AMD не предусматривают. Всего в новой серии AMD анонсировала 12 процессоров, с количеством ядер от 8 до 64 (16—128 потоков), в вариациях с настраиваемым теплопакетом и фиксированным в соответствии со стандартом NEBS (Network Equipment-Building System); последний также предусматривает более широкий диапазон рабочих температур (от -5 до +85 °C). Нельзя, впрочем, сказать, что теплопакет как-то особенно низок даже у младших 8-ядерных моделей — он стартует с отметки 80 Вт (для модели с настраиваемым TDP этот показатель можно снизить до 70 Вт), а в максимальных конфигурациях система охлаждения CPU должна справляться с отводом 175–225 Ватт. Для периферийных систем и телекоммуникационного оборудования этого добиться не всегда просто. Можно назвать и другие ограничения: так, использование прежнего дизайна IOD-чиплета означает поддержку памяти со скоростью до DDR5-4800, причём лишь при одном модуле DIMM на канал, а поддержка 3DS RDIMM отсутствует, что ограничивает максимальный объём оперативной памяти отметкой 1152 Гбайт (12 × 96 Гбайт RDIMM). Из 96 линий PCIe лишь половина может работать в режиме CXL. А конкуренция со стороны Intel в этом сегменте будет очень жёсткой: поскольку речь идёт о телекоммуникационном оборудовании, у «синих» имеется готовый стек решений vRAN и отлично подходящие для его запуска процессоры Xeon EE с поддержкой vRAN Boost, а также ещё более экономичные Xeon D-2700 с интегрированным 100GbE-контроллером, поддерживающие третье поколение Quick Assist и полноценные расширения AVX-512 и VNNI/DL. AMD хочет противопоставить этому «чистую» вычислительную мощность, достигаемую за счёт количества ядер. Это может сыграть решающую роль при использовании программного обеспечения, неспособного использовать все преимущества ускорителей в процессорах Intel. Также потенциальных заказчиков должна привлечь низкая совокупная стоимость владения для систем на базе EPYC Siena, достигаемой за счёт высокой удельной производительности новых процессоров. Компания сообщает, что процессоры EPYC 8004 уже доступны в новых периферийных серверах таких производителей, как Dell, Lenovo и Supermicro, анонсировала новые решения и Giga Computing. Также поддержали выпуск новых чипов Microsoft Azure и Ericsson. Последняя, напомним, весной этого года подписала с AMD соглашение о разработке открытого RAN-стека, что позволит ей «отвязаться» в своих продуктах от решений исключительно Intel.

18.09.2023 [19:26], Сергей Карасёв

Giga Computing представила серверы с AMD EPYC Siena и материнские платы с новым сокетом SP6Компания Giga Computing, серверное подразделение Gigabyte, анонсировала серверы и материнские платы с поддержкой процессоров AMD EPYC 8004 Siena, которые впервые были представлены ещё в июне 2022 года. Чипы Siena оптимизированы с точки зрения энергоэффективности. Они насчитывают до 64 ядер Zen 4 с возможностью одновременного выполнения двух потоков инструкций. Реализована поддержка оперативной памяти DDR5-4800 и 96 линий PCIe 5.0. Показатель TDP варьируется от 80 до 200 Вт. В семейство серверов Giga Computing с поддержкой EPYC Siena вошли модели R143-EG0 (rev. AAC1), R143-EG0 (rev. AAC2), R143-EG2 (rev. AAC2), R243-EG0 (rev. AAF1) и R243-EG0 (rev. AAL1). Первые три устройства выполнены в формате 1U, два других — 2U. Говорится о поддержке накопителей SATA и SAS, тогда как R143-EG0 (rev. AAC2) и R143-EG2 (rev. AAC2) также допускают установку NVMe-устройств.

Источник изображений: Giga Computing Модели R143-EG0 (rev. AAC1) и R143-EG0 (rev. AAC2) снабжены четырьмя посадочными местами для накопителей LFF/SFF, а версия R143-EG2 (rev. AAC2) — 12 отсеками для SFF-изделий. Серверы располагают разъёмом для двухслотовой карты расширения и коннектором OCP 3.0. Питание обеспечивают два блока мощностью 1300 Вт с сертификатом 80 Plus Platinum. В свою очередь, серверы R243-EG0 (rev. AAF1) и R243-EG0 (rev. AAL1) наделены 12 отсеками для накопителей LFF/SFF, а также четырьмя разъёмами для двухслотовых ускорителей. Есть разъём OCP 3.0. Первое из этих устройств оснащено двумя блоками питания мощностью 2400 Вт с сертификатом 80 Plus Platinum, второе — двумя блоками на 2700 Вт с сертификатом 80 Plus Titanium.  Анонсированы также материнские платы ME33-AR0, ME03-CE0, ME03-CE1 и ME03-PE0. Первая имеет формат E-ATX, три других — ATX. Поддерживается работа с памятью DDR5, накопителями NVMe и SATA. Задействован BMC-контроллер Aspeed AST2600. Предусмотрены слоты PCIe 5.0 и 4.0.

14.09.2023 [19:06], Владимир Мироненко

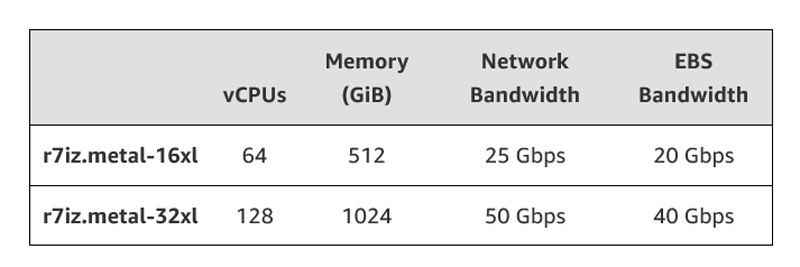

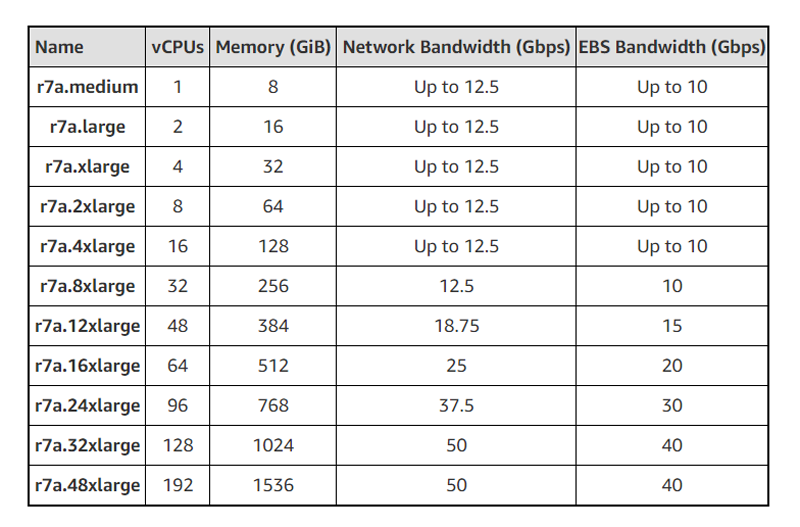

Amazon объявила о доступности EC2-инстансов R7iz (Intel) и R7a (AMD) для нагрузок с повышенными требованиями к памятиAmazon объявила о доступности инстансов EC2 R7iz на базе процессоров Intel Xeon Sapphire Rapids с постоянной турбо-частотой всех ядер 3,9 ГГц и EC2 R7a на базе процессоров AMD EPYC Genoa с максимальной частотой 3,7 ГГц.

Изображения: Amazon AWS Оба семейства предназначены для рабочих нагрузок, требующих больше памяти, вертикального масштабирования, а также более высокую производительность и низкую задержку сети и томов EBS. Экземпляры R7iz ориентированы на EDA, СУБД с высокими лицензионными сборами за ядро, системы анализа данных и финансовые расчёты. К каждому R7iz можно подключить до 88 EBS-томов.  Amazon EC2 R7iz включают фирменные ускорители Intel — инструкции AMX доступны для всех размеров инстансов R7iz, а ускорители Intel QAT, IAA и DSA будут доступны на экземплярах r7iz.metal-16xl и r7iz.metal-32xl. Инстансы R7iz уже доступны в регионах US East (Северная Вирджиния, США) и US West (Орегон, США). Bare metal варианты появятся чуть позже.  Скорость подключения инстансов к сети составляет до 50 Гбит/с, а к EBS-томам — до 40 Гбит/с. Лимиты одинаковы для R7iz и R7a, но к AMD-инстансам можно подключить до 128 EBS-томов. R7a построены на базе системы AWS Nitro, используют адаптеры AWS Elastic Fabric Adapter (EFA), поддерживают инструкции AVX-512 VNNI и формат bfloat16.  Сообщается, что R7a сертифицированы SAP и идеально подходят для высокопроизводительных рабочих нагрузок с интенсивным использованием памяти, таких как базы данных (No)SQL и in-memory, распределённые кеши, аналитика больших данных в реальном времени и системы EDA. Инстансы Amazon EC2 R7a доступны в следующих регионах AWS: US East (Огайо, США), US East (Северная Вирджиния, США), US West (Орегон, США) и EU (Ireland).

14.09.2023 [18:34], Сергей Карасёв

AMD выпустила шесть новых процессоров EPYC Milan — спустя 2,5 года после анонса семействаКомпания AMD, по сообщению ресурса Tom's Hardware, без громких анонсов пополнила семейство процессоров EPYC Milan шестью новыми моделями: EPYC 7663P, EPYC 7643P, EPYC 7303P, EPYC 7303, EPYC 7203P и EPYC 7203. Чипы вышли спустя примерно два с половиной года после дебюта соответствующего семейства. Сейчас их постепенно вытесняют более новые AMD EPYC 7004 (Genoa). Изделия EPYC 7663P и EPYC 7643P фактически представляют собой версии EPYC 7663 и EPYC 7643 для односокетных серверов. Процессор EPYC 7663P насчитывает 56 ядер (112 потоков) с базовой частотой 2,0 ГГц (повышается до 3,5 ГГц). Показатель TDP равен 240 Вт. Цена — $3139. Модель EPYC 7643P имеет 48 ядер (96 потоков) с частотой 2,3–3,6 ГГц, обладает показателем TDP в 225 Вт и стоит $2722. P-версии практически вдвое дешевле своих старших собратьев, рассчитанных на двухсокетные системы.

Источник изображения: AMD Решения EPYC 7303P и EPYC 7303 располагают 16 ядрами (32 потока) с тактовой частотой 2,4–3,4 ГГц, а их показатель TDP равен 130 Вт. Чипы ориентированы на одно- и двухпроцессорные серверы соответственно. Цена — $594 и $604. Наконец, изделия EPYC 7203P и EPYC 7203 содержат восемь ядер (16 потоков) с частотой 2,8–3,4 ГГц. Величина TDP составляет 120 Вт. Стоят эти модели $338 и $348. Все новые процессоры поддерживают 128 линий PCIe 4.0. Объём кеша L3 равен 256 Мбайт у двух старших версий и 64 Мбайт у четырёх других.

29.08.2023 [14:20], Сергей Карасёв

AMD EPYC Siena для периферийных вычислений получат до 64 ядер Zen4Компания AMD, по сообщению ресурса ServeTheHome, поделилась информацией о процессорах EPYC Siena, предназначенных для использования в телекоммуникационной сфере и системах периферийных вычислений. В основу этих изделий положена микроархитектура Zen 4 — AMD придерживается стратегии формирования различных чиплетных сборок вокруг унифицированного IO-блока. В состав Siena войдут до 64 вычислительных ядер с возможностью одновременной обработки до 128 потоков инструкций. Говорится о поддержке шести каналов оперативной памяти DDR5 DRAM. Величина TDP новых процессоров составит от 70 до 225 Вт. По имеющейся информации, чипы будут функционировать на тактовой частоте от 2,2 до 2,55 ГГц. Объём кеша L3 будет достигать 128 Мбайт, что в два раза меньше по сравнению с процессорами AMD EPYC Rome с 64 ядрами.

Источник изображений: AMD (via ServeTheHome) Предполагается, что Siena будут использовать новую платформу SP6, которая значительно проще, чем SP5, применяемая для чипов EPYC серии 9000. Системы на платформе Siena смогут использовать модули DDR5-4800. Поначалу в семейство Siena войдут как минимум шесть моделей — с 8, 16, 24, 32, 48 и 64 ядрами. Процессоры, как ожидается, появятся на рынке в конце текущего или в начале следующего года. Чипы предназначены для серверов с низким энергопотреблением, которым не требуется максимальная производительность.

26.08.2023 [13:54], Сергей Карасёв

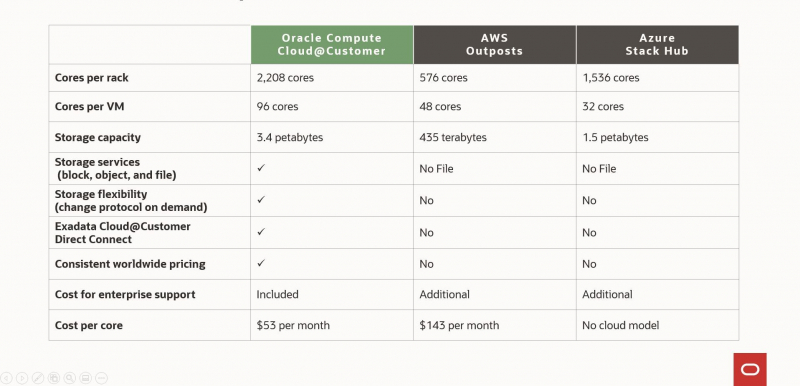

Облако в стойке: Oracle представила компактную платформу Compute Cloud@Customer на базе AMD EPYC GenoaКорпорация Oracle анонсировала аппаратную платформу Compute Cloud@Customer, занимающую всего одну 42U-стойку и позволяющую заказчикам разворачивать облачную инфраструктуру локально в своих дата-центрах. Клиенты могут запускать рабочие нагрузки и управлять ими, используя тот же стек, API и инструменты, что и OCI (Oracle Cloud Infrastructure), но в небольших масштабах. Базовая конфигурация Compute Cloud@Customer включает 552 вычислительных ядра AMD EPYC Genoa, 6,7 Тбайт оперативной памяти и 150 Тбайт полезного хранилища. При необходимости система может быть масштабирована до 6624 процессорных ядер (2208 ядер в стойке), 80,4 Тбайт ОЗУ и 3,4 Пбайт для хранения данных. В зависимости от конфигурации решение весит от 559 до 796 кг. Типовое энергопотребление варьируется от 6500 до 14 690 Вт, а максимальное значение достигает 20 988 Вт. Платформа, как отмечается, даёт возможность удовлетворить самые жёсткие нормативные требования к месту расположения данных и задержкам в приложениях и в то же время использовать современные сервисы OCI. По заявлениям Oracle, решение Compute Cloud@Customer превосходит по производительности локальные системы конкурентов, такие как Microsoft Azure Stack Hub или AWS Outposts. Стоимость эксплуатации составляет $53/мес. за каждое вычислительное ядро. |

|