Материалы по тегу: dell

|

07.12.2023 [23:02], Владимир Мироненко

Dell выпустит серверы с ИИ-ускорителями AMD Instinct MI300XDell и AMD объявили о расширении портфеля решений Dell Generative AI Solutions с целью ускорения обработки сложных рабочих нагрузок и предоставления компаниям больше возможностей для развёртывания приложений генеративного ИИ. Новые решения включают серверы Dell PowerEdge XE9680 с ускорителями AMD Instinct MI300X. Сервер будет оснащён восемью ускорителями, что даст общую ёмкость HBM3 1,5 Тбайт и FP16-производительность более 10 Пфлопс. Использование PowerEdge XE9680 с MI300X позволит компаниям сократить занимаемую площадь в ЦОД, снизить совокупную стоимость владения и получить конкурентное преимущество, говорит Dell. Для масштабирования нагрузок компания предлагет Ethernet-фабрику с 400G-коммутаторами PowerSwitch Z9664F-ON. PowerEdge XE9680 поставляется с приложением Dell OpenManage Enterprise для администрирования и мониторинга систем. Также сообщается, что сервер обеспечивает высокую защищённость данных благодаря интегрированной киберзащите и использованию концепции Zero Trust.

Источник изображения: Dell Dell также пополнила платформу Dell Generative AI Solutions решением Dell Validated Design for Generative AI with AMD, которое упрощает надёжное развёртывание генеративного ИИ. Его выход ожидается в следующем году с ИИ-платформами на базе AMD ROCm и открытых больших языковых моделей (LLM). Dell PowerEdge XE9680 с ускорителями AMD Instinct MI300X и Dell Validated Design for Generative AI with AMD появится на рынке в I половине 2024 года.

03.12.2023 [00:52], Сергей Карасёв

Финский подземный дата-центр Verne Global внедрил жидкостное охлаждениеИсландский оператор дата-центров Verne Global объявил о развёртывании СЖО в подземном кампусе ЦОД The Rock, который находится в Финляндии. Внедрение системы поможет повысить эффективность при решении сложных и ресурсоёмких задач, связанных с ИИ и машинным обучением. Verne Global отмечает, что рост популярности ИИ и НРС усиливает потребность в надёжных решениях для охлаждения дата-центров. Среднестатистический ЦОД расходует на отвод тепла от своей инфраструктуры до 40 % от общего энергопотребления. Поэтому внедрение передовых решений в области охлаждения позволяет снизить общую стоимость владения. Verne Global также подчёркивает, что по мере роста популярности моделей ИИ увеличиваются требования к плотности размещения оборудования в ЦОД. Это создаёт дополнительную нагрузку на традиционные средства воздушного охлаждения. В результате, жидкостное охлаждение становится всё более востребованным среди операторов дата-центров.

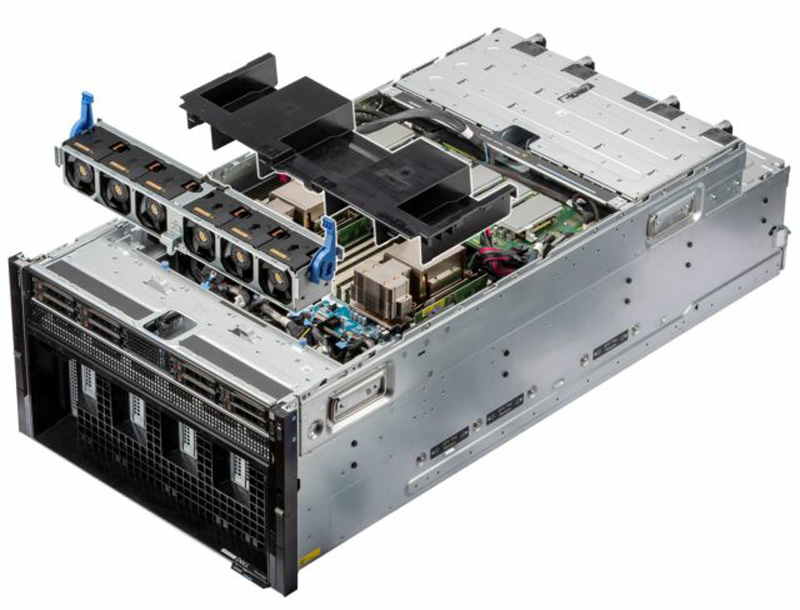

Источник изображения: Verne Global Сообщается, что проект по оснащению площадки The Rock жидкостным охлаждением реализован Verne Global в сотрудничестве с Dell и Intel. В частности, задействованы системы Dell DLC3000 с процессорами Intel Xeon Sapphire Rapids, обеспечивающие мощность до 80 кВт на стойку. Это первый случай использования данного решения Dell в Финляндии. Площадка Rock, созданная финским провайдером Ficolo на базе бывших военных туннелей в скале в Пори, расположена примерно в 200 км от Хельсинки. Инвестиционный фонд Digital 9 Infrastructure (D9) из Великобритании приобрёл компанию Ficolo в 2022 году, а затем объединил её ЦОД с другими активами Verne Global. Недавно D9 объявил о продаже своей доли в Verne Global частной инвестиционной компании Ardian из Франции. Сумма сделки не раскрывается.

02.12.2023 [03:31], Владимир Мироненко

Спрос на ИИ-серверы Dell вырос почти вдвое, но из-за NVIDIA ждать поставок придётся более 9 месяцевDell Technologies объявила результаты III квартала 2024 финансового года, завершившегося 3 ноября 2023 года. Выручка компании составила $22,25 млрд, что на 10 % меньше по сравнению с аналогичным периодом предыдущего финансового года и ниже прогнозов аналитиков LSEG, ожидавших $23 млрд. Операционная прибыль компании составила $1,5 млрд (GAAP) и $2 млрд (non-GAAP), что на 16 и 17 % меньше год к году соответственно. Разводнённая прибыль на акцию (GAAP) составила $1,36 или $1,88 на акцию (non-GAAP). Денежный поток от операционной деятельности за III квартал составил $2,2 млрд, что обусловлено прибыльностью и высокими показателями оборотного капитала. За последние 12 месяцев компания получила денежный поток от операционной деятельности в размере $9,9 млрд. Выручка инфраструктурного подразделения ISG (Infrastructure Solutions Group) в III квартале составила $8,5 млрд, не изменившись по сравнению с предыдущим кварталом и снизившись на 12 % по сравнению с аналогичным кварталом предыдущего финансового года. Выручка от реализации СХД составила $3,84 млрд, снизившись на 13 % год к году и на 8 % последовательно. У подразделения CSG (Client Solutions Group), занимающегося клиентским оборудованием, выручка сократилась на 11 % до $12,3 млрд. Выручка от продажи серверов и сетевого оборудования упала год к году на 10 % до $4,66 млрд, увеличившись вместе с тем по сравнению с предыдущим кварталом на 9 % благодаря продажам ИИ-серверов, которые принесли компании более $500 млн. Dell завершила квартал с оставшимися обязательствами по исполнению контрактов в размере $39 млрд. Немалая часть из них приходится на ИИ-серверы с ускорителями NVIDIA, дефицит которых привёл к тому, что заказчики Dell вынуждены ждать поставок до 39 недель — большая часть ускорителей отгружается гиперскейлерам. «Мы поставили серверов, оптимизированных для ИИ, на сумму более $0,5 млрд, включая наши XE9680, XE9640, XE8640 и серверы R750 и R760xa. Спрос на эти ИИ-серверы последовательно почти удвоился, и спрос по-прежнему значительно превышает предложение <…> XE9680 — самое быстрорастущее решение в истории Dell», — отметил зампредседателя и главный операционный директор Джефф Кларк (Jeff Clarke). Компания уже подготовила цепочку поставок, чтобы в ближайшее время постараться утроить отгрузки ИИ-серверов. Компания повысила прогноз по прибыли на акцию за год до $6,63±0,10 по сравнению с предыдущим прогнозом в $6,30±0,20 на акцию. Ожидаемая выручка за 2024 финансовый год равна $88,1 млрд, что на 14 % ниже выручки годом ранее. В текущем квартале компания ожидает получить выручку в размере $22 млрд±0,5 млрд, что в среднем значении на 12 % меньше показателя предыдущего года.

30.11.2023 [13:52], Сергей Карасёв

Dell построит ИИ-кластер из 10 тыс. NVIDIA H100 для компании ImbueНезависимая исследовательская ИИ-компания Imbue и Dell Technologies объявили о заключении соглашения по созданию нового высокопроизводительного вычислительного кластера на основе серверов PowerEdge для обучения базовых моделей. Проект оценивается в $150 млн. Imbue разрабатывает собственные базовые ИИ-модели, оптимизированные специально для рассуждений: они способны при необходимости запрашивать дополнительную информацию, анализировать и критиковать свои собственные результаты, а также разбивать сложную задачу на несколько более простых для повышения эффективности выполнения.

Источник изображения: Dell Imbue уже использует кластер на базе серверов Dell PowerEdge XE9680 с ускорителями NVIDIA H100. Новый проект предполагает развёртывание платформы, насчитывающей почти 10 тыс. чипов H100. Отмечается, что Imbue и Dell разработали систему, включающую в себя сравнительно небольшие кластеры, которые позволяют проводить эксперименты с ИИ-моделями на новых архитектурах. Такие узлы могут быть объединены в крупный кластер для эффективного обучения крупномасштабных базовых моделей. Основная цель Imbue заключается в создании специализированных ИИ-агентов, не требующих постоянного контроля со стороны пользователей. Они смогут выполнять самые разные задачи, включая написание программного кода, анализ сложных данных и пр. Ранее в текущем году Imbue привлекла на развитие $200 млн. Деньги поступили в том числе от NVIDIA.

22.11.2023 [13:54], Сергей Карасёв

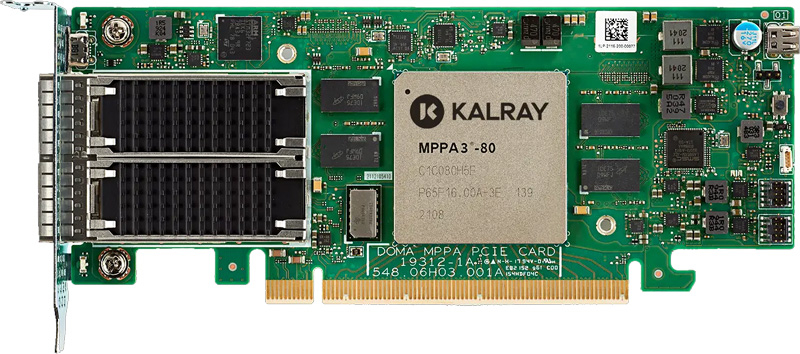

Kalray выпустила СХД NG-Box на базе серверов Dell PowerEdge с DPUБазирующийся во Франции компания Kalray, разработчик сетевых сопроцессоров (DPU), объявила о доступности дезагрегированного массива хранения NG-Box. Решение ориентировано на приложения с интенсивным использованием данных, в частности, на ИИ-задачи. В основу системы положены стоечный сервер Dell PowerEdge R750 типоразмера 2U и карта Kalray DPU Smart Storage Accelerator (SSA). Задействованы два процессора Intel Xeon Silver 4316 (20 ядер; 40 потоков; 2,3 ГГц; 150 Вт). Объём оперативной памяти DDR4-3200 составляет 128 Гбайт. В зависимости от модификации используются один или два контроллера Kalray K200-LP. Представлены три модификации СХД — NG-Box 8x, NG-Box 16x и NG-Box 24x с поддержкой соответственно 8, 16 и 24 NVMe SSD. Могут устанавливаться накопители вместимостью 1,96/3,84/7,68/15,36 Тбайт. Во всех случаях заявленная производительность достигает 2 млн IOPS. Максимальная пропускная способность составляет до 40 Гбайт/с при чтении и до 20 Гбайт/с при записи. Применены два системных модуля M.2 на 480 Гбайт каждый в виде массива RAID 1.

Источник изображения: Kalray СХД располагает двумя сетевыми портами 1GbE, а также портами 200 Гбит/с на базе NVIDIA ConnectX. Питание обеспечивает блок мощностью 1400 Вт с сертификатом 80 Plus Platinum. Использована система воздушного охлаждения с шестью высокопроизводительными вентиляторами. Габариты составляют 772,14 × 482 × 86,8 мм. NG-Box является частью платформы управления данными Kalray NGenea, которая также включает NG-Stor и NG-Hub. NG-Stor — это уровень хранения для ресурсоёмких рабочих нагрузок, основанный на высокопроизводительной параллельной файловой системе. В свою очередь, NG-Hub — простой в использовании веб-интерфейс, который позволяет централизованно управлять всем хранилищем.

22.11.2023 [01:23], Владимир Мироненко

NVIDIA в рекордные сроки завершила строительство первой фазы израильского ИИ-суперкомпьютера Israel-1Компания NVIDIA объявила во вторник о досрочном завершении сборки первой фазы ИИ-суперкомпьютера Israel-1, анонсированного летом этого года. Сообщается, что суперкомпьютер уже доступен для использования исследовательскими и опытно-конструкторскими группами компании, а также её отдельными партнёрами. После завершения строительства Israel-1 станет самым мощным ИИ-суперкомпьютером в Израиле. По данным NVIDIA, первая фаза компьютерной системы была построена менее чем за 20 недель или почти на два месяца раньше намеченных сроков — это намного быстрее, чем требуется для создания традиционных суперкомпьютеров, которые могут создаваться и несколько лет. Первая фаза Israel-1, обеспечивающая производительность при обработке ИИ-нагрузок в 4 Эфлопс (FP8) и при научных вычислениях в 65 Пфлопс (FP64), послужит испытательным стендом для разработанной в Израиле сетевой Ethernet-платформы NVIDIA/Mellanox Spectrum-X, предназначенной для повышения производительности и эффективности облачных ИИ-сервисов. В конечном итоге Israel-1 будет содержать 256 систем NVIDIA HGX H100, включающих в общей сложности 2048 ускорителей NVIDIA H100 с более чем 34 млн ядер CUDA и 1 млн тензорных ядер четвёртого поколения, 2560 единиц DPU BlueField-3 и 80 коммутаторов Spectrum-4. Первая фаза суперкомпьютера включает 128 серверов Dell PowerEdge XE9680 на базе платформы NVIDIA HGX H100, 1280 единиц DPU BlueField-3 и более 40 коммутаторов Spectrum-4.

19.11.2023 [22:52], Сергей Карасёв

Dell и Hugging Face упростят развёртывание генеративного ИИ на базе локальной инфраструктурыКомпании Dell Technologies и Hugging Face объявили о заключении соглашения о сотрудничестве, цель которого заключается в том, чтобы помочь корпоративным клиентам в создании, настройке и использовании собственных систем на базе генеративного ИИ. Партнёры сформируют новый портал на платформе Hugging Face. Через него будут доступны специальные контейнеры и сценарии, которые помогут заказчикам быстро и безопасно разворачивать открытые ИИ-модели, доступные в репозитории Hugging Face. Ранее похожее решение было представлено для моделей Llama 2.

Источник изображения: pixabay.com Для локального развёртывания ИИ-приложений будет использоваться оборудование Dell — серверы PowerEdge и СХД. Со временем на портале появятся дополнительные контейнеры с оптимизированными моделями для инфраструктуры Dell, предназначенные для внедрения ИИ-систем нового поколения. Ранее компания представила расширеннное портфолио комплексных решений и сервисов для «локализации» генеративного ИИ.

19.11.2023 [22:42], Сергей Карасёв

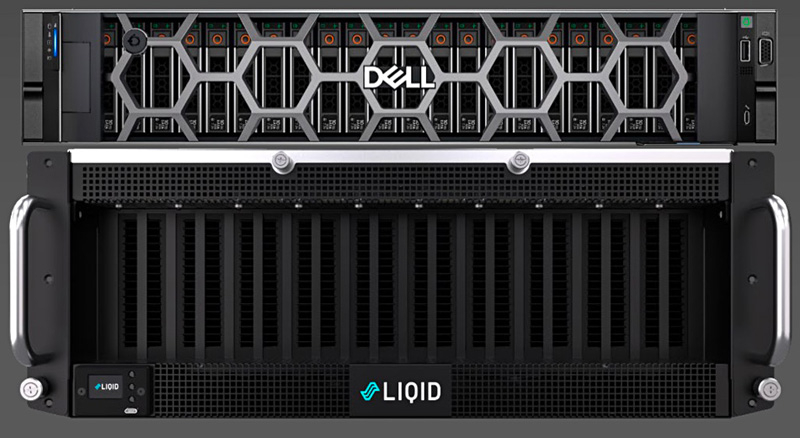

16 ускорителей на один сервер: Liqid и Dell представили платформу UltraStack L40SКомпания Liqid в партнёрстве с Dell Technologies анонсировала эталонную архитектуру UltraStack L40S для формирования систем с высокой плотностью компоновки GPU и иных ускорителей — до 16 шт. на один сервер. Такие платформы могут использоваться для ИИ-приложений, работы с большими языковыми моделями (LLM), задач НРС и пр. Новинка доступна в конфигурациях UltraStack x8 и UltraStack x16. В качестве хост-сервера в составе решения выступает Dell PowerEdge R760xa на базе Intel Xeon Sapphire Rapids: применены два процессора Xeon Gold 6430 (32 ядра; 64 потока; 1,9 ГГц). Объём оперативной памяти в первом случае составляет 1 Тбайт, во втором — 2 Тбайт. К серверу подключаются модули Liqid PCIe Chassis. Версия UltraStack x8 использует два таких модуля: задействованы восемь ускорителей NVIDIA L40S PCIe с 48 Гбайт памяти GDDR6 и SSD-хранилище вместимостью 30 Тбайт (NVMe). Вариант UltraStack x16 комплектуется тремя модулями Liqid PCIe Chassis: объединены 16 карт NVIDIA L40S, а ёмкость хранилища составляет 60 Тбайт.

Источник изображения: Liqid Платформа UltraStack L40S предполагает применение восьми двухпортовых сетевых адаптеров NVIDIA ConnectX-7 (16 × 200 Гбит/с), DPU BlueField-3, двух хост-адаптеров Liqid Gen 4.0 x16 HBA, а также коммутатора PCIe 4.0 на 24/48 портов. Среднее энергопотребление UltraStack x8 заявлено на уровне 4,5 кВт, UltraStack x16 — 7,5 кВт. Система базируется на ПО Liqid Matrix. Компания Liqid утверждает, что по сравнению с четырьмя серверами формата 2U, каждый из которых содержит четыре ускорителя NVIDIA L40S, её система UltraStack с 16 такими картами обеспечивает на 35 % более высокую производительность, сокращение энергопотребления на 35 % и снижение общей стоимости владения на 25 %.

12.11.2023 [16:53], Сергей Карасёв

Dell представила объектное All-Flash хранилище ObjectScale XF960 для генеративного ИИКорпорация Dell анонсировала программно определяемую объектную систему хранения данных ObjectScale XF960. Новинка, ставшая первым представителем семейства ObjectScale X Series, ориентирована на задачи генеративного ИИ и аналитику в реальном времени. В состав системы входят серверы PowerEdge, коммутаторы, необходимое стоечное оборудование и кабели. Применена программная платформа ObjectScale v1.3. В зависимости от конфигурации ObjectScale XF960 объединяет от 4 до 16 узлов. Каждый из них несёт на борту два 32-ядерных процессора Intel Xeon Sapphire Rapids и 256 Гбайт оперативной памяти. Предусмотрены два загрузочных накопителя с зеркалированием для обеспечения надёжности. Сетевая подсистема включает по два порта 100 GbE (back-end) и 25 GbE (front-end). Система относится к классу All-Flash. В оснащение каждого из 2U-узлов входят 24 накопителя NVMe на основе флеш-памяти TLC вместимостью 30,72 Тбайт. Таким образом, суммарная «сырая» ёмкость составляет 737,3 Тбайт. В максимальной конфигурации с 16 узлами общая вместимость достигает 11,8 Пбайт.

Источник изображения: Dell Dell заявляет, что ObjectScale XF960 — это полностью интегрированная система «под ключ» и самая мощная в мире объектная платформа хранения данных, созданная специально для Kubernetes. Система способна обеспечить скорость чтения до 5,7 Гбайт/с и скорость записи до 5,0 Гбайт/с на каждый узел.

03.11.2023 [22:48], Владимир Мироненко

Llama 2 в хорошие руки: Dell и Meta✴ предложили готовый программно-аппаратный комплекс для локального развёртывания ИИDell и Meta✴ предложили совместную разработку для повышения эффективности работы компаний в области генеративного ИИ, основанную на использовании большой языковой модели Meta✴ Llama 2 и инфраструктуры Dell. Запуск таких приложений генеративного ИИ, как чат-боты, виртуальные помощники, в том числе для написания кода, предполагает обучение моделей на собственных данных компаний. Однако решения в публичных облаках хотя и удобны, часто имеют определённые ограничения, включая риски безопасности, связанные с суверенитетом данных, а также непредсказуемые затраты и проблемы с соблюдением регуляторных требований.

Источник изображения: Dell Локальное развёртывания открытых больших языковых моделей (LLM) вроде Llama 2 обеспечивает клиентам предсказуемые затраты и полный контроль над своими данными, снижая риск для безопасности и утечки интеллектуальной собственности, а также обеспечивая соответствие нормативным требованиям, говорит Dell. Решения Dell Generative AI Solutions вместе с Dell Validated Design for Generative AI предлагают клиентам готовый, предварительно протестированный программно-аппаратный, специально созданный для работы с генеративным ИИ. Теперь же Dell в сотрудничестве с Meta✴ расширила свой портфель предложений для работы с генеративным ИИ — клиентам доступно упрощённое развёртывание и тюнинг ИИ-моделей Meta✴ Llama 2 от Meta✴ в локальной среде. Решение Dell Validated Design for Generative AI вместе с Llama 2 предоставляет компаниям готовую инфраструктуру, ПО и сервисы Dell для оптимизации развёртывания и управления локальными ИИ-проектами. Llama 2 протестирована и проверена Dell, в том числе при работе с (SFT), LoRA и p-tuning на моделях с 7, 13 и 70 млрд параметров Благодаря руководству по развёртыванию и настройке компании смогут быстро запустить свою ИИ-инфраструктуру и использовать Llama 2 с большей предсказуемостью. В частности, доступны анализ использования памяти, задержек и эффективности LLM. «Наша цель — стать предпочтительным поставщиком локальной инфраструктуры для клиентов, развёртывающих Llama 2, и предоставить нашим клиентам лучшие в своём классе генеративные решения ИИ», — сообщила компания. Аппаратная основа включает серверы PowerEdge XE9680, а также PowerEdge R760xa (с NVIDIA L40S). |

|