Материалы по тегу: aws

|

21.03.2024 [00:51], Владимир Мироненко

Облачный ИИ-суперкомпьютер AWS Project Ceiba получит 21 тыс. суперчипов NVIDIA GB200

aws

b100

dgx cloud

gb200

gtc 2024

hardware

nvidia

ии

инференс

информационная безопасность

облако

суперкомпьютер

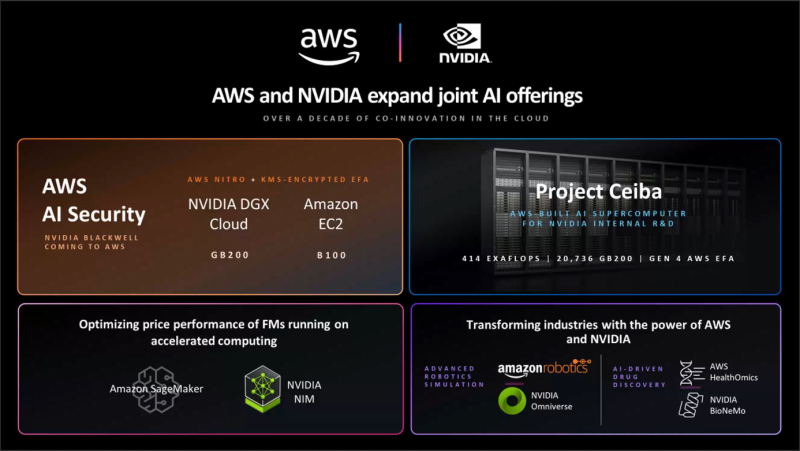

Amazon Web Services (AWS) и NVIDIA объявили о расширении сотрудничества, в рамках которого ускорители GB200 и B100 вскоре появятся в облаке AWS. Кроме того, компании объявили об интеграции Amazon SageMaker с NVIDIA NIM для предоставления клиентам более быстрого и дешёвого инференса, о появлении в AWS HealthOmics новых базовых моделей NVIDIA BioNeMo, а также о поддержке AWS обновлённой платформы NVIDIA AI Enterprise. Сотрудничество двух компаний позволило объединить в единую инфраструктуру их новейшие технологии, в том числе многоузловые системы на базе чипов NVIDIA Blackwell, ПО для ИИ, AWS Nitro, сервис управления ключами AWS Key Management Service (AWS KMS), сетевые адаптеры Elastic Fabric (EFA) и кластеры EC2 UltraCluster. Предложенная инфраструктура и инструменты позволят клиентам создавать и запускать LLM с несколькими триллионами параметров быстрее, в больших масштабах и с меньшими затратами, чем позволяли EC2-инстансы с ускорителями NVIDIA прошлого поколения. AWS предложит кластеры EC2 UltraClusters из суперускорителей GB200 NVL72, которые позволят объединить тысячи чипов GB200. GB200 будут доступны и в составе инстансов NVIDIA DGX Cloud. AWS также предложит EC2 UltraClusters с ускорителями B100. Amazon отмечает, что сочетание AWS Nitro и NVIDIA GB200 ещё больше повысит защиту ИИ-моделей: GB200 обеспечивает шифрование NVLink, EFA шифрует данные при передаче между узлами кластера, а KMS позволяет централизованно управлять ключами шифрования. Аппаратный гипервизор AWS Nitro, как и прежде, разгружает CPU узлов, беря на себя обработку IO-операций, а также защищает код и данные во время работы с ними. Эта возможность, доступная только в сервисах AWS, была проверена и подтверждена NCC Group. Инстансы с GB200 поддерживают анклавы AWS Nitro Enclaves, что позволяет напрямую взаимодействовать с ускорителем и данными в изолированной и защищённой среде, доступа к которой нет даже у сотрудников Amazon. Чипы Blackwell будут использоваться в обновлённом облачном суперкомпьютере AWS Project Ceiba, который будет использоваться NVIDIA для исследований и разработок в области LLM, генерация изображений/видео/3D, моделирования, цифровой биологии, робототехники, беспилотных авто, предсказания климата и т.д. Эта первая в своём роде машина на базе GB200 NVL72 будет состоять из 20 736 суперчипов GB200, причём каждый из них получит 800-Гбит/с EFA-подключение. Пиковая FP8-производительность системы составит 414 Эфлопс.

15.03.2024 [23:15], Владимир Мироненко

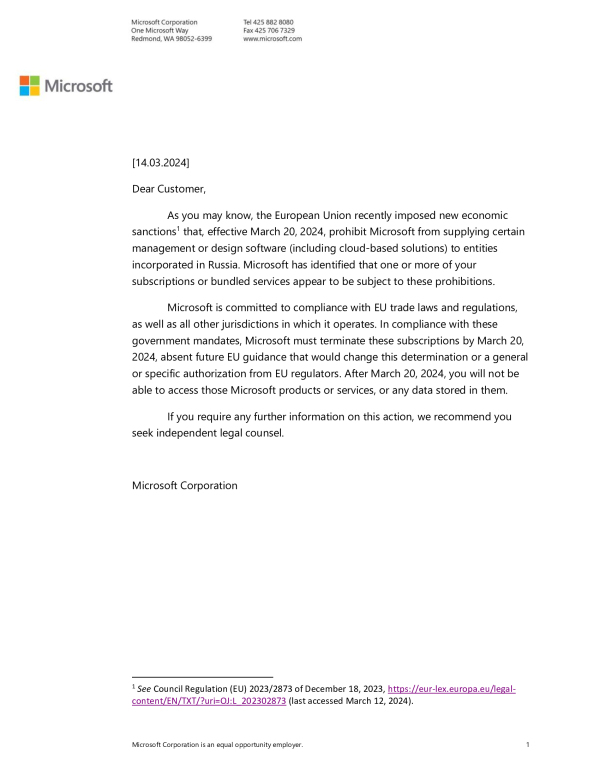

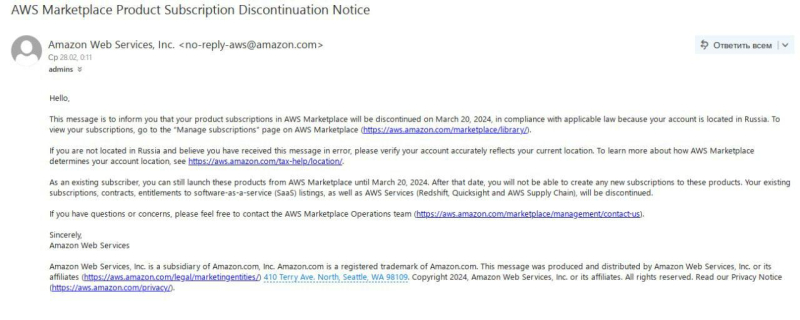

Amazon и Microsoft заблокируют 20 марта облачные сервисы для клиентов из РоссииMicrosoft разослала клиентам в России уведомление о том, что 20 марта прекратит подписки «на определённое программное обеспечение для управления или проектирования (включая облачные решения) для организаций, зарегистрированных в России», сообщила в своём Telegram-канале вице-президент по инвестициям Softline Елена Волотовская. По факту это может означать полное отключение доступа к облачным решениям, отметила она, добавив, что аналогичные уведомления получили российские клиенты Amazon. В письме Microsoft сообщается, что решение было принято в связи со вступлением с 20 марта в силу санкций ЕС в отношении России. «Microsoft должна прекратить действие этих подписок к 20 марта 2024 года, до будущих указаний ЕС, которые изменят это решение, или общего или специального разрешения от регулирующих органов ЕС. После 20 марта 2024 года вы не сможете получить доступ к этим продуктам или услугам Microsoft, а также к любым данным, хранящимся в них», — указано в документе. В связи с этим компания Softline рекомендовала российским компаниям, которые до сих пор пользуются услугами этих компаний, в оперативном порядке сделать резервное копирование данных со всех облачных сервисов Microsoft, Amazon и Google, в т.ч. на местах пользователя. Компания также создала информационный канал, где заказчики иностранных облачных решений смогут найти ответы и оперативно проконсультироваться по проблемам, которые могут возникнуть с 20 марта 2024 года. Некоторые другие игроки оперативно отреагировали на сложившуюся ситуацию. Так, в TrueConf сообщили о решении открыть горячую линию и начать предоставлять бесплатные лицензии на сервер ВКС и корпоративный мессенджер TrueConf Server всем организациям, срочно ищущим замену решениям Microsoft Teams и Skype for Business. Похожее предложение есть и у DION. UPD 16.03.2024: появились уточнения относительно того, что будет заблокировано Microsoft — Azure (в том числе Azure Stack) и все компоненты Microsoft 365. Кроме того, возможна деактивация развёрнутых локально Microsoft Office, SQL Server, BizTalk Server, System Center, Visual Studio. Windows Server и клиентские Windows, вероятно, затронуты не будут.

06.03.2024 [23:05], Владимир Мироненко

AWS отменила плату за выгрузку данных при переезде на другую платформу, последовав примеру Google CloudAmazon Web Services Inc. сообщила об отмене так называемой «платы за выход», которую взимала с клиентов при перемещении больших объёмов данных из своего облака в связи с переходом на другую платформу. Ранее о таком же решении объявила Google Cloud. Компания заявила в своём блоге, что предложение нацелено на пользователей, которые хотят навсегда перенести большие объёмы данных из AWS. Как полагает ресурс SiliconANGLE, решение AWS связано с требованиями Европейского закона о данных (EU Data Act), принятого в январе этого года и заставившего облачных провайдеров упростить переход клиентов к конкурентам. Требования закона вступят в силу позже в этом году. Вместе с тем в AWS заявили, что её предложение также распространяется на клиентов, использующих мультиоблачный подход, и на тех, кто хочет вернуть свои данные назад. До этого AWS позволила клиентам бесплатно выгружать до 100 Гбайт данных со своих облачных платформ, но для крупнейших клиентов этого было явно недостаточно. Плата за исходящий трафик была значительной, и они фактически оказались заложниками облака Amazon. Компания сообщила в своем блоге, что клиентам, прежде чем перенести свои данные на альтернативную платформу, необходимо будет связаться с сотрудниками службы поддержки. После утверждения заявки клиента ему будет предоставлено достаточное количество кредитов на передачу данных для выполнения миграции. Предоставленные кредиты DTO будут действительны в течение 60 дней. За это время клиент должен полностью завершить переход. Подход к миграции Amazon почти такой же, как у Google Cloud, хотя есть различия. Google Cloud тоже требует, чтобы клиенты получили одобрение, прежде чем приступить к реализации перехода, но настаивает на том, чтобы клиенты полностью закрыли свои учётные записи, чтобы можно было претендовать на предоставление кредитов, тогда как AWS этого не делает.

05.03.2024 [21:51], Руслан Авдеев

AWS и DataVolt потратят $10 млрд на строительство ЦОД в Саудовской АравииВласти Саудовской Аравии заявили, что компании, включая Amazon Web Services (AWS) намерены вложить более $10 млрд в строительство дата-центров на территории страны. Bloomberg сообщает, что пустынное королевство намерено диверсифицировать и модернизировать зависимую от нефти экономику в рамках инициативы Saudi Vision 2030. Сделки анонсировали в ходе ежегодного мероприятия LEAP в столице Эр-Рияде. Предполагается поддержка развития на территории Саудовской Аравии технических стартапов. Одна только AWS потратит $5,3 млрд на создание нового облачного региона к 2026 году, а также поможет в обучении местных разработчиков. В прошлом году техногигант наряду с Google и Microsoft открыл в стране региональную штаб-квартиру — меры были приняты в ответ на новые правила, согласно которым зарубежные компании должны организовать деятельность в стране, чтобы избежать потери государственных контрактов. Масштабные инвестиции Amazon станут своеобразным магнитом для других компаний и привлечения иностранных средств, пишет Bloomberg — страна намерена стать технологическим хабом для всего Ближнего Востока. Ещё $5 млрд инвестирует местный оператор ЦОД DataVolt на строительство кампуса ёмкостью более 300 МВт. IBM намерена выделить $250 млн на центр по разработке ПО, а сервис-провайдер ServiceNow потратит $500 млн на локализацию своих сервисов. Намерена открыть центр производства и выполнения заказов в стране и компания Dell. По данным Datacenter Dynamics, многие зарубежные бизнесы временно приостанавливали инвестиции в Саудовскую Аравию с 2018 года по политическим мотивам, но уже в конце 2020 года Google без лишнего шума анонсировала открытие облачного региона в Саудовской Аравии при сотрудничестве с нефтяной Aramco — регион запустили ещё в прошлом ноябре. Microsoft тоже строит ЦОД и выступает против призывов правозащитников и политиков отменить строительство. Наконец, в последние годы регионы запустили Oracle и Huawei. Более того, по некоторым данным саудовские спецслужбы, возможно, взламывали смартфон основателя Amazon Джеффа Безоса (Jeff Bezos), но, похоже, между властями Саудовской Аравии и AWS всё же достигнут необходимый баланс интересов для дальнейшего развития бизнеса Amazon в стране.

05.03.2024 [18:59], Руслан Авдеев

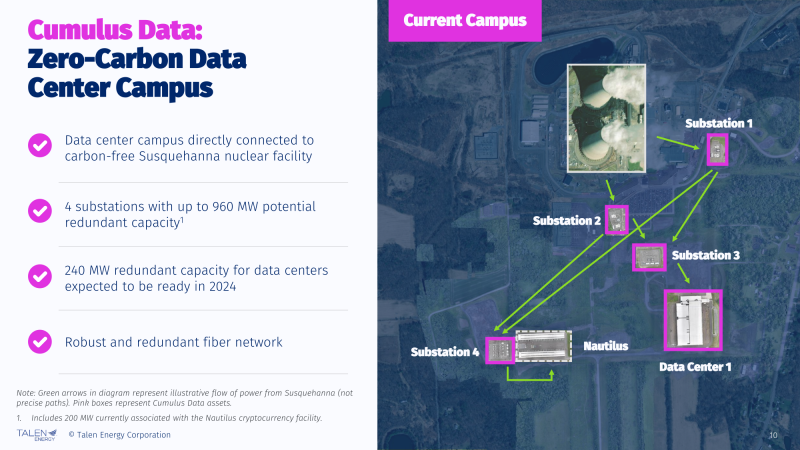

Атомное облако: AWS приобрела гигаваттный кампус ЦОД, запитанный от АЭСОблачный гигант Amazon Web Services (AWS) приобрёл у Talen Energy Corporation кампус ЦОД, строящийся у атомной электростанции Susquehanna в Пенсильвании (США). По данным Datacenter Dynamics, ещё на минувшей неделе Talen объявила о продаже кампуса «крупному облачному провайдеру». В презентации для инвесторов было раскрыто, что речь идёт об AWS. Кампус Cumulus Data площадью более 485 га впервые анонсировали ещё в 2021 году — он находится в непосредственной близости от принадлежащей Talen АЭС мощностью 2,5 ГВт. Компания начала строительство в 2021 году и завершила первый объект гиперскейл-уровня на 28,9 тыс. м2 и 48 МВт в 2023 году. Параллельно возводилась отдельная ферма для криптомайнинга для компании TeraWulf, но она, похоже, не является частью сделки с Amazon. Площадка и активы Cumulus Data проданы за $650 млн — $350 млн выплачены сразу, ещё $300 млн будут выплачены после завершения этапов строительства, запланированных на 2024 год. Дополнительно предусмотрена и гарантированная продажа «безуглеродной» электроэнергии станции Susquehanna по фиксированной цене, которая может быть пересмотрена только через 10 лет. В Talen уже сообщили, что довольны сделкой, которая принесла выгода и обеспечила возврат инвестиций. Ожидается, что в конечном итоге ёмкость кампуса AWS достигнет 960 МВт. У компании есть обязательства по минимальному потреблению энергии, они будут увеличиваться в течение нескольких лет с шагом в 120 МВт. Впрочем, у AWS остаётся возможность единовременно ограничить обязательства лимитом в 480 МВт. В рамках сделки предусмотрены и другие договорённости. Например, Talen обязуется поставлять с АЭС электричество кампусу AWS в рамках PPA. Электростанция Susquehanna Steam Electric мощностью 2,5 ГВт была сдана в эксплуатацию в 1983 году — это одна из крупнейших атомных станций в США. Теперь ей владеет Talen Energy, основанная в 2015 году. В 2020 году компания основала Cumulus Growth для инвестиций «на стыке цифровой инфраструктуры и энергетики», а также Cumulus Coin, занимающуюся майнингом криптовалют. В России с 2018 года действует дата-центр «Калининский», расположенный у одноимённой АЭС в Тверской области.

28.02.2024 [18:52], Руслан Авдеев

AWS откроет в Мексике свой первый облачный регион и вложит $5 млрд в развитие ЦОДAmazon Web Services (AWS) намерена построить свой второй крупный облачный регион в Латинской Америке, на этот раз — в Мексике. Первым стал AWS South America в Сан-Паулу (Бразилия). Блог компании сообщает, что новый регион введут в эксплуатацию в начале 2025 года. AWS Mexico Region получит три независимые зоны доступности, удалённые друг от друга, но связанные широкополосными оптоволоконными каналами с низким уровнем задержки сигнала. Компания давно инвестирует в развитие информационной инфраструктуры в Мексике. С 2020 года AWS запустила семь узлов Amazon CloudFront и сервис AWS Outposts, а в 2023 году появились выделенные локальные зоны AWS Local Zone. Клиентами AWS в стране уже являются Banco Santander Mexico, SkyAlert, Cinepolis, Aeromexico, Kueski и Bolsa Institucional de Valores (BIVA).

Источник изображения: Andrew Schultz/unsplash.com По данным Datacenter Dynamics, местные власти приветствовали инвестиции AWS и расширение спектра услуг в стране, это поможет её цифровой и экономической трансформации. По их словам, готовность компании инвестировать в Мексику демонстрирует уверенность бизнеса в привлекательности условий ведения дел. Власти также приветствовали инвестиции AWS в обучение студентов, мелкие, средние и крупные компании и взаимодействие с предпринимателями цифрового сектора. В стране уже присутствуют регионы Huawei Cloud и Oracle, а Microsoft и Google также планируют запустить здесь собственные сервисы. AWS сообщила о планах инвестировать $5 млрд в развитие своих мексиканских дата-центров в течение 15 лет. Компания также работает над четырьмя облачными регионами — в Германии, Малайзии, Новой Зеландии и Таиланде — и 15 новыми зонами доступности.

24.02.2024 [02:48], Сергей Карасёв

Samsung, Telus и AWS развернули платформу облачного роуминга мобильных абонентовSamsung, канадская телекоммуникационная компания Telus и облачная платформа Amazon Web Services (AWS) объявили о создании первой в Северной Америке системы виртуального роуминга. Предполагается, что новая архитектура по сравнению с традиционными подходами позволит повысить надёжность связи и обеспечить более высокую скорость для абонентов, находящихся за пределами домашнего региона. Традиционно роуминговый трафик (голосовые вызовы, данные и SMS) маршрутизируется через страну нахождения оператора, с которым у абонента заключён договор на обслуживание. Однако такая схема может приводить к задержкам соединения и снижению общей производительности. Новая технология предусматривает использование виртуализированных роуминговых шлюзов в облачных регионах AWS по всему миру. В результате, трафик абонентов Telus больше не требуется маршрутизировать через Канаду — он обрабатывается ближайшим к пользователю дата-центром AWS. Это значительно повышает доступность и производительность мобильных сервисов, включая интернет-подключение через сотовую сеть. Новая платформа базируется на технологии Cloud-native Core разработки Samsung для обработки мобильных данных и ng-voice для голосовых вызовов. Облачное ядро разработано с прицелом на гибкость и масштабируемость. Предложенное решение позволяет оптимизировать производительность и, в конечном итоге, повысить качество услуг для пользователей. Испытания виртуализированных роуминговых шлюзов начнутся в I квартале 2024 года.

23.02.2024 [19:19], Сергей Карасёв

Microsoft переманила ответственного за аппаратные решения облака AWSСтарший руководитель отдела аппаратного обеспечения Amazon Web Services (AWS) Ахмед Шихаб (Ahmed Shihab), по сообщению ресурса Datacenter Dynamics, принял решение покинуть компанию. Он присоединился к конкурирующей облачной платформе Microsoft Azure. Шихаб пришёл в Amazon в 2016 году, заняв пост вице-президента подразделения по инфраструктурному оборудованию. Его функции заключались во «внедрении инноваций, создании и эксплуатации» вычислительных платформ и систем хранения данных AWS. Отмечается, что он существенно повлиял на развитие мировой облачной индустрии. До прихода в Amazon Шихаб исполнял обязанности вице-президента и главного архитектора компании NetApp, а до этого проработал восемь лет в другой фирме, занимающейся облачными инфраструктурами, — Xyratex, где дошёл до должности старшего вице-президента и генерального менеджера. В Microsoft он займётся «созданием передовых сервисов хранения данных для платформы Azure». Отмечается, что в AWS в последнее время наблюдается отток специалистов, занимающих руководящие должности. Так, в июне 2023 года компанию неожиданно покинул глава отдела проектирования, строительства и эксплуатации дата-центров Крис Вондерхар (Chris Vonderhaar). Впоследствии он перешёл на работу в Google Cloud. А подразделение AWS в Индии и Южной Азии в течение нескольких месяцев потеряло двух руководителей. Вайшали Кастуре (Vaishali Kasture), временный глава AWS India, подала в отставку в декабре 2023-го. Ранее с этой же должности ушёл Пунит Чандок (Puneet Chandok), перейдя в индийское подразделение Microsoft. AWS остаётся крупнейшим игроком мирового облачного рынка. По оценкам Synergy Research Group, в IV квартале 2023 года доля компании составляла 31 %. На втором месте располагается Microsoft Azure с 24 %, а замыкает тройку Google Cloud с показателем около 11 %.

06.02.2024 [23:09], Владимир Мироненко

AWS будет зарабатывать до $1 млрд в год на одних только IPv4-адресахКак и было объявлено, с 1 февраля облачный провайдер Amazon Web Services (AWS) ввёл плату за аренду публичных IPv4-адресов. Хотя размер платы невелик — всего $0,005/час или $43,80 за год аренды, выручка AWS от этого бизнеса, по оценкам гендиректора провайдера сетевых сервисов Border0 Андре Тунка (Andree Toon), может составить от $400 млн до $1 млрд в год, пишет The Register. Тунк использовал данные Amazon о принадлежащих ей подсетях, согласно которым у неё есть как минимум 131 932 752 IPv4-адреса. При текущей средней рыночной цене адреса на уровне $35/шт. всё IPv4-богатство AWS стоит порядка $4,6 млрд. Тунк также прозондировал все адреса компании и выявил, что около 6 млн из них доступны в Сети. Впрочем, политики безопасности могут скрывать многие из них, так что фактическое количество активных адресов IPv4 может быть намного больше. В итоге Тунк предложил консервативную оценку выручки AWS от аренды IPv4, согласно которой от 10 до 30 % адресов действительно используются в течение целого года. Amazon скупала IPv4-адреса не один год, расходуя на их приобретение значительные средства. Например, в 2020 году президент неправительственной организации радиолюбителей Amateur Radio Digital Communications (ARDC) подтвердил получение от Amazon $108 млн за 4 млн адресов IPv4. В 2018 году она купила у GE 16 млн адресов, а в 2017-м — 8 млн адресов у MIT. За три последних года Amazon суммарно выкупила не менее 30 млн адресов. При этом, как ранее отмечал Тунк, некоторые приобретённые IPv4-блоки представлены в списке подсетей Amazon лишь частично. «Хотя это новая дополнительная плата, которая в некоторой степени снижает ценность, которую клиент получает от сервисов AWS, это вполне реалистичная сумма, учитывая дороговизну и ограниченность IPv4-адресов, а также тот факт, что он предоставляется клиенту как услуга, аналогичная инфраструктурному оборудованию», — отметил старший директор по исследованиям IDC Эндрю Басс (Andrew Buss).

05.02.2024 [18:08], Владимир Мироненко

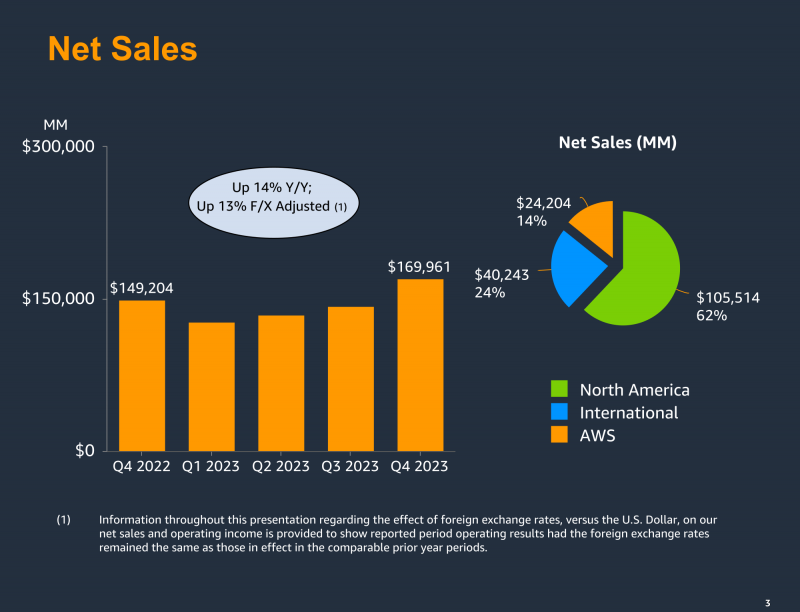

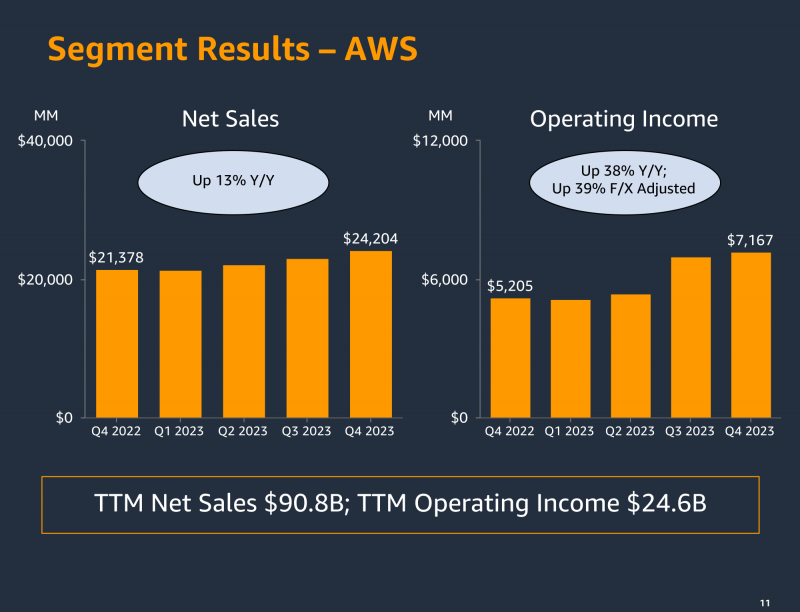

AWS увеличила квартальную выручку до $24,2 млрд, оправдав ожидания Уолл-стритКомпания Amazon.com, Inc. объявила результаты IV квартала и 2023 года в целом, завершившегося 31 декабря 2023 года, которые оказались выше прогнозов экспертов Уолл-стрит. Выручка облачного подразделения Amazon Web Services (AWS) за отчётный квартал выросла год к году на 13 % до $24,2 млрд, что совпало с прогнозом аналитиков StreetAccount. Два предыдущих квартала выручка увеличивалась на 12 %. Умеренное ускорение «оставляет некоторые сомнения относительно того, сможет ли облачное подразделение противостоять конкурентам», — цитирует ресурс Bloomberg заявление Скай Канавес (Sky Canaves), старшего аналитика Insider Intelligence. Также следует отметить, что год назад квартальная выручка AWS выросла на 20 %. В свою очередь, финансовый директор Amazon Брайан Олсавски (Brian Olsavsky) выразил оптимизм по поводу перспектив роста AWS в течение года. «Мы начинаем видеть, что клиенты сокращают свою работу по оптимизации затрат и переводят обсуждение в сторону возобновления миграции в облако, которую они, возможно, отложили в прошлом году», — сказал Олсавски, добавив, что существует большой интерес к продуктам генеративного ИИ облачного подразделения. Гендиректор Amazon Энди Ясси (Andy Jassy) заявил в ходе телефонной конференции с аналитиками, что сервисы генеративного ИИ остаются «относительно небольшим» бизнесом, но компания считает, что они могут приносить «десятки миллиардов долларов» дохода в течение следующих нескольких лет. Операционная прибыль AWS за IV квартал составила $7,2 млрд, в то время как годом ранее этот показатель был равен $5,2 млрд. В целом за 2023 год выручка AWS составила $90,8 млрд (рост 13 % год к году), операционная прибыль — $24,6 млрд ($22,8 млрд в 2022 году). При этом подразделение сбавило темпы роста и уступило долю глобального рынка Microsoft Azure и Google Cloud. В числе достижений в минувшем году AWS назвала запуск суверенного облака для Европы, расширение сотрудничества с Amgen в разработке технологий генеративного ИИ, а также заключение соглашений по поводу статуса предпочтительного провайдера облачных сервисов с рядом компаний, включая автопроизводителя SAIC MOTOR, телекоммуникационную компанию Axiata Group Berhad и производителя электромобилей BYD. Что касается результатов Amazon в целом, что в IV квартале компания получила выручку в размере $170,0 млрд (рост 14 %). За год выручка составила $574,8 млрд (рост 12 %). Операционная прибыль за квартал выросла до $13,2 млрд с $2,7 млрд годом ранее, за год показатель составил $36,9 млрд ($12,2 млрд в 2022 году). Чистая прибыль выросла в IV квартале до $10,6 млрд или $1,0 на разводнённую акцию с $0,3 млрд или $0,003 на разводнённую акцию годом ранее. За год чистая прибыль компании составила $30,4 млрд или $2,90 на разводнённую акцию по сравнению с $2,7 млрд убытков или $0,27 на разводнённую акцию в 2022 году. В текущем квартале Amazon планирует получить выручку в размере $138–$143,5 млрд (рост 8–13 %) и операционную прибыль в пределах от $8 до $12 млрд. Аналитики, опрошенные LSEG (ранее Refinitiv), ожидают выручку в размере 141,2 млрд. В свою очередь, по данным опроса аналитиков ресурсом Bloomberg, прогноз по выручке равен $142 млрд, по операционной прибыли — $9,12 млрд. |

|